Seu site pode parecer perfeito e ainda assim ter um desempenho ruim nos mecanismos de busca. É aí que os rastreadores da web fazem a diferença. Eles atuam como os primeiros visitantes do seu site e decidem como os mecanismos de busca enxergam seu conteúdo. Verificar manualmente as páginas em busca de erros leva tempo e aumenta a probabilidade de erros. Os rastreadores resolvem isso rapidamente.

Os rastreadores da web examinam cada página, link e recurso para descobrir problemas de SEO que prejudicam a visibilidade. Eles ajudam os mecanismos de busca a entender a estrutura do seu site, indexar o conteúdo corretamente e classificar as páginas mais rapidamente. Do controle do orçamento de rastreamento à criação de links internos e à velocidade da página, os rastreadores permitem decisões inteligentes de SEO.

Neste guia, você descobrirá os melhores rastreadores da web e como eles fortalecem sua estratégia de SEO.

Resumo: Os melhores rastreadores da web que potencializam o SEO e a visibilidade do site

- Os rastreadores da web examinam seu site para ajudar os mecanismos de busca a indexar páginas, entender a estrutura e melhorar o desempenho de SEO.

- Diferentes tipos de rastreadores servem a propósitos distintos, incluindo rastreadores gerais, focados, incrementais, de mecanismos de busca, de mídias sociais e de ferramentas de SEO.

- Ferramentas populares de rastreamento como Googlebot, Bingbot, AhrefsBot e Screaming Frog ajudam a identificar problemas técnicos, backlinks e lacunas de otimização.

- O gerenciamento adequado de rastreadores usando robots.txt, firewalls e CDN protege seu site de bots maliciosos, ao mesmo tempo que garante uma indexação saudável.

Entendendo os rastreadores da Web

Os rastreadores da web, também conhecidos como bots rastreadores da web, são programas automatizados que percorrem a internet, organizando conteúdo para otimização de mecanismos de busca, coleta de dados e fins de monitoramento.

Eles são essenciais para indexar páginas da web em mecanismos de busca como Google, Binge outros, e para usar um token de agente do usuário para se identificar ao acessar sites.

Os rastreadores da web também ajudam a monitorar e otimizar grandes sites, identificando problemas de SEO, como conteúdo duplicado, links quebrados e meta tags incorretas. Eles analisam as páginas rastreadas, garantindo que estejam estruturadas corretamente e incluídas nos sitemaps XML para indexação.

Compreender o funcionamento de vários rastreadores da web por meio de uma lista abrangente pode ajudar a otimizar páginas de destino para mecanismos de busca.

Leia mais: O que é um rastreador web?

Como funcionam os rastreadores da web

Os rastreadores da web examinam sistematicamente as páginas da web e indexam seu conteúdo, armazenando-o no índice de um mecanismo de busca para recuperação em resposta às consultas de pesquisa do usuário. Eles seguem os links de uma página para outra e aderem ao protocolo robots.txt, ajudando os rastreadores dos mecanismos de busca a determinar quais URLs eles podem acessar em seu site.

Os desenvolvedores ou profissionais de marketing podem especificar no arquivo robots.txt de seus sites se aprovam ou negam determinados rastreadores com base no token do agente do usuário.

Compreender o processo de rastreamento pode tornar seu site mais acessível e visível para mecanismos de busca como Google e Bing. Esse conhecimento pode, em última análise, melhorar o posicionamento e a visibilidade do seu site nos resultados de busca.

Deseja melhorar o SEO do seu site?

Deixe que nossos especialistas em SEO melhorem seu posicionamento e impulsionem o tráfego orgânico com otimizações técnicas e de estrutura de sites comprovadas.

Saiba mais: Como corrigir o problema "Novo motivo que impede a indexação dos seus vídeos"

Tipos de rastreadores da Web

Existem três tipos principais de rastreadores da web:

- Os rastreadores gerais, também conhecidos como rastreadores da web ou spiders, navegam sistematicamente pelas páginas da web para coletar dados para indexação pelos mecanismos de busca. Os mecanismos de busca usam essas informações para classificar e apresentar os resultados da pesquisa.

- Os rastreadores focados têm como alvo tipos específicos de conteúdo ou sites. Eles são projetados para coletar informações sobre um tópico ou domínio específico.

- Os rastreadores incrementais rastreiam apenas as páginas da web que foram atualizadas desde o último rastreamento. Isso permite que eles coletem conteúdo novo ou modificado de forma eficiente, sem precisar rastrear o site inteiro novamente.

Por outro lado, os rastreadores focados coletam páginas da web que se enquadram em uma propriedade ou tópico específico, priorizando estrategicamente a área rastreada e mantendo uma coleção de páginas relevantes.

Os rastreadores incrementais revisitam e rastreiam novamente os URLs para manter os dados rastreados atualizados, tornando-os ideais para cenários que exigem dados atualizados e consistentes.

Relacionado: Como funcionam os mecanismos de busca: rastreamento, indexação e classificação

Os 14 principais rastreadores da web que você deve conhecer

Esta lista abrangente de rastreadores detalha os rastreadores da web mais comuns, destacando seu papel na indexação de mecanismos de busca, coleta de dados e análise. Esses rastreadores incluem:

- Googlebot

- Bingbot

- Bot do Yandex

- Google Bardo

- Openai ChatGPT

- Rastreador do Facebook

- Bot do Twitter

- Bot do Pinterest

- AhrefsBot

- SemrushBot

- Rastreador de campanhas da Moz Rogerbot

- Apache Nutch

- Sapo Gritante

- HTTrack

Analisaremos cada um desses itens na lista de rastreadores, com foco em seus papéis e funcionalidades exclusivos.

Veja também: As melhores ferramentas de auditoria de sites para SEO

Googlebot

O Googlebot, também conhecido como agente de usuário Googlebot, é o principal rastreador da web do Google. Ele é responsável por indexar e renderizar páginas para o mecanismo de busca. O Google rastreia sites do Google seguindo links, examinando páginas da web e respeitando as regras do arquivo robots.txt, garantindo que o conteúdo do site seja acessível ao mecanismo de busca do Google.

Conhecer o Googlebot é essencial, pois seu processo de rastreamento pode melhorar significativamente o posicionamento e a visibilidade do seu site nos mecanismos de busca.

Bingbot

O Bingbot é o rastreador da Microsoft para o mecanismo de busca Bing, com uma abordagem de indexação que prioriza dispositivos móveis. Ele se concentra em indexar a versão móvel dos sites, enfatizando o conteúdo otimizado para dispositivos móveis nos resultados de pesquisa, para atender à natureza centrada em dispositivos móveis da navegação moderna.

É semelhante ao Googlebot, e o principal mecanismo de busca chinês é um rastreador crucial para aqueles que desejam que seu conteúdo seja encontrado em vários mecanismos de busca.

Confira: As melhores estratégias de marketing digital para negócios locais

Bot do Yandex

O Yandex Bot é o rastreador web do mecanismo de busca russo Yandex, que prioriza o alfabeto cirílico e o conteúdo em russo. Ele é responsável por rastrear e indexar sites predominantemente russos, atendendo às necessidades específicas do público de língua russa.

O Yandex Bot é um rastreador web essencial para quem visa o mercado russo e deseja otimizar seu conteúdo.

Google Bardo

O Google Bard é um rastreador da web para as APIs generativas Bard e Vertex AI do Google, ajudando editores da web a gerenciar melhorias em seus sites.

Pode auxiliar os editores da web na gestão de melhorias do site, oferecendo respostas mais precisas, integrando-se com os aplicativos e serviços do Google e permitindo que os editores controlem os dados de treinamento de IA.

Aumenta a visibilidade do conteúdo original e fornece citações genuínas nas respostas, tornando-se uma ferramenta valiosa para editores da web que buscam otimizar seu conteúdo.

Descubra: Como migrar do Blogger para o WordPress

OpenAI ChatGPT

da OpenAI aprimora significativamente as capacidades da IA, resultando em uma experiência de usuário superior e respostas mais precisas do chatbot baseado em IA.

É um rastreador web usado pela OpenAI para treinar e aprimorar seus modelos de linguagem. O GPTBot coleta dados disponíveis publicamente em sites para melhorar modelos de inteligência artificial como o GPT-4.

Continue lendo: Como visualizar páginas em cache do Google

Rastreadores de mídias sociais

Os rastreadores de mídias sociais aprimoram a experiência e o engajamento do usuário em diversas plataformas. Eles indexam e exibem conteúdo compartilhado em plataformas como Facebook, Twitter e Pinterest, fornecendo aos usuários prévias visualmente atraentes e informativas do conteúdo da web.

Agora vamos discutir três rastreadores de mídias sociais notáveis: Facebook Crawler, Twitterbot e Pinterestbot.

Rastreador do Facebook

O Facebook Crawler coleta informações de sites compartilhadas na plataforma e gera prévias detalhadas, incluindo título, breve descrição e imagem em miniatura.

Isso permite que os usuários tenham uma visão geral rápida do conteúdo compartilhado antes de clicar no link, melhorando a experiência do usuário e incentivando o engajamento.

O Facebook Crawler otimiza o conteúdo compartilhado na plataforma, proporcionando aos usuários uma experiência de navegação visualmente atraente e informativa.

Bot do Twitter

O Twitterbot, o rastreador web do Twitter, indexa e exibe URLs compartilhadas para mostrar prévias de conteúdo da web na plataforma.

Ao gerar cartões de pré-visualização com títulos, descrições e imagens, o Twitterbot oferece aos usuários um panorama do conteúdo compartilhado, incentivando o engajamento e a interação.

O Twitterbot otimiza o conteúdo para a plataforma Twitter, facilitando aos usuários a descoberta e a interação com o conteúdo compartilhado.

Bot do Pinterest

É um rastreador web para a plataforma social visual, com foco na indexação de imagens e conteúdo para exibição na plataforma. O Pinterestbot rastreia e indexa imagens, permitindo que os usuários descubram e salvem inspirações visuais por meio de pins e pastas.

Sua função principal é proporcionar aos usuários uma experiência de navegação visualmente atraente e organizada, permitindo que explorem e interajam com conteúdo personalizado de acordo com seus interesses.

Saiba mais: Por que seu WordPress está lento?

Lista de ferramentas de SEO para rastreamento

Os rastreadores de ferramentas de SEO são essenciais para coletar dados para análise e otimização do desempenho de sites em diversas plataformas de SEO.

Esses rastreadores fornecem informações valiosas sobre a estrutura do site, backlinkse engajamento do usuário, ajudando proprietários e profissionais de marketing de sites a tomar decisões informadas para melhorar sua presença online.

Vamos agora explorar três ferramentas populares de rastreamento de SEO: AhrefsBot, SemrushBot e o rastreador de campanhas da Moz, Rogerbot.

AhrefsBot

O AhrefsBot é um rastreador web que indexa links para o software de SEO Ahrefs. Ele visita 6 bilhões de sites diariamente, sendo o segundo rastreador mais ativo depois do Googlebot.

O AhrefsBot rastreia sites para coletar informações sobre backlinks, palavras-chave e outros fatores de SEO. Essas informações são usadas para embasar decisões de otimização.

O AhrefsBot é uma ferramenta valiosa para quem deseja melhorar o posicionamento e a visibilidade do seu site nos mecanismos de busca. Também é útil para proprietários de sites, profissionais de SEO e profissionais de marketing.

SemrushBot

O SemrushBot é um robô rastreador da web utilizado pela Semrush, uma empresa líder em software de SEO. Sua função é adquirir e catalogar dados de sites para uso de seus clientes em sua plataforma. Ele gera uma lista de URLs de páginas da web, visita cada uma delas e armazena determinados hiperlinks para visitas futuras.

Os dados do SemrushBot são utilizados em diversas ferramentas do Semrush, incluindo:

- Mecanismo de busca de backlinks públicos

- Ferramenta de auditoria do site

- Ferramenta de auditoria de backlinks

- Ferramenta de construção de links

- Assistente de redação

Essas ferramentas fornecem informações valiosas para otimizar o desempenho do site e as estratégias de SEO.

Rastreador de campanhas da Moz Rogerbot

O Rogerbot, rastreador de campanhas da Moz, é um rastreador web desenvolvido especificamente para auditorias de sites do Moz Pro Campaign. Ele é fornecido pela Moz, o principal site de SEO.

Ele coleta conteúdo para auditorias de campanhas do Moz Pro e segue as regras do robots.txt para garantir a conformidade com as preferências do proprietário do site.

O Rogerbot é uma ferramenta valiosa para proprietários e profissionais de marketing de sites que desejam melhorar o posicionamento e a visibilidade de seus sites nos mecanismos de busca. Ele utiliza auditorias abrangentes do site e estratégias de otimização baseadas em dados.

Relacionado: SEO otimizado no WordPress: um guia completo

Rastreadores de código aberto

Os rastreadores de código aberto oferecem flexibilidade e escalabilidade para rastreamento de sites específicos ou para rastreamento em larga escala na internet. Esses rastreadores podem ser personalizados para atender a necessidades particulares.

Isso os torna um recurso valioso para desenvolvedores web e profissionais de SEO que buscam otimizar o desempenho de seus sites.

Agora vamos analisar três crawlers de código aberto: Apache Nutch, Screaming Frog e HTTrack.

Apache Nutch

O Apache Nutch é ideal para desenvolvedores web e profissionais de SEO que precisam de um rastreador web personalizável para atender às suas necessidades específicas, seja para rastrear um site em particular ou realizar rastreamentos em larga escala na internet.

- Um rastreador web de código aberto flexível e escalável

- Utilizado para rastrear sites específicos ou toda a internet

- Baseado em estruturas de dados do Apache Hadoop

- Ele pode ser configurado em detalhes.

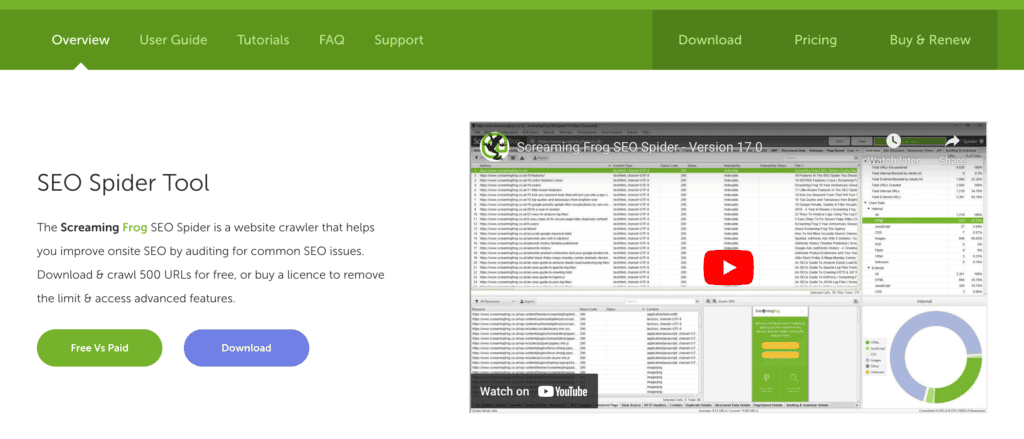

Sapo Gritante

O Screaming Frog é uma ferramenta para desktop que rastreia sites sob a perspectiva de SEO, apresentando elementos do site em abas para análise e filtragem em tempo real. É reconhecido por sua interface amigável e pela rapidez em gerar resultados técnicos que maximizam o rastreamento pelo Google.

O Screaming Frog é um recurso essencial para desenvolvedores web e profissionais de SEO que buscam aprimorar o desempenho de seus sites por meio de auditorias abrangentes e estratégias de otimização baseadas em dados.

HTTrack

O HTTrack é um software gratuito que permite baixar e espelhar sites, sendo compatível com diversos sistemas e oferecendo muitos recursos. Ele funciona utilizando um rastreador web para recuperar os arquivos do site e organizá-los em uma estrutura que preserva a estrutura de links relativos do site original.

Isso permite que os usuários naveguem pelo site baixado offline usando qualquer navegador da web. O HTTrack é uma ferramenta valiosa para proprietários de sites e profissionais de marketing que desejam criar uma cópia local de um site para navegação offline ou para fins de replicação.

Saiba mais: Migre seu site para o WordPress

Protegendo seu site contra rastreadores maliciosos

Proteger seu site contra rastreadores maliciosos é essencial para prevenir fraudes, ataques e roubo de informações.

Identificar e bloquear esses rastreadores maliciosos pode proteger o conteúdo do seu site, os dados dos usuários e a sua presença online. Isso torna a experiência de navegação dos seus visitantes mais segura e protegida.

Agora vamos discutir técnicas para identificar rastreadores maliciosos e métodos para bloquear o acesso deles ao seu site.

Identificando rastreadores maliciosos

A identificação de rastreadores maliciosos envolve a verificação de agentes de usuário, incluindo a string completa do agente de usuário, a string do agente de usuário da área de trabalho e os endereços IP nos registros do site.

Você pode diferenciar entre rastreadores web legítimos e maliciosos analisando essas características. Isso ajuda você a tomar as medidas apropriadas para proteger seu site de possíveis ameaças.

Monitorar regularmente os registros de acesso do seu site e implementar medidas de segurança pode ajudar a manter um ambiente online seguro para seus usuários.

Técnicas de bloqueio

Técnicas como o ajuste de permissões por meio do arquivo robots.txt e a implementação de medidas de segurança, como firewalls de aplicativos da web (WAF) e redes de distribuição de conteúdo (CDN), podem bloquear rastreadores maliciosos.

Utilizar a diretiva 'Disallow' seguida do nome do agente do usuário do rastreador que você deseja bloquear no seu arquivo robots.txt é uma maneira eficaz de bloquear rastreadores da web específicos.

Além disso, a implementação de um WAF pode proteger um site de rastreadores maliciosos, filtrando o tráfego antes que ele chegue ao site. Em contrapartida, uma CDN pode mitigar esse problema, roteando as solicitações para o servidor mais próximo da localização do usuário, reduzindo o risco de ataques de bots ao site.

A utilização dessas técnicas de bloqueio pode ajudar a proteger seu site de rastreadores maliciosos e garantir uma experiência de navegação segura para seus visitantes.

Relacionado: Melhores provedores de serviços de segurança para WordPress

Resumo

Em conclusão, os rastreadores da web desempenham um papel vital no cenário digital, pois indexam páginas da web, coletam dados e permitem que os mecanismos de busca forneçam resultados de alta qualidade.

Compreender os diferentes tipos de rastreadores da web e suas funções pode fornecer informações valiosas para otimizar seu site e se manter à frente no mundo digital.

Ao implementar medidas de segurança e técnicas de bloqueio adequadas, você pode proteger seu site de rastreadores maliciosos e manter um ambiente online seguro para seus usuários.

Perguntas frequentes

Quais são alguns exemplos de robôs rastejantes?

Exemplos de rastreadores da web incluem Googlebot (versões para desktop e dispositivos móveis), Bingbot, DuckDuckBot, Yahoo Slurp, YandexBot, Baiduspider e ExaBot.

O que é um mecanismo de busca com rastreador?

Um mecanismo de busca rastreador, também conhecido como spider, robô ou bot, é um programa automatizado que navega sistematicamente por páginas da web para indexá-las para mecanismos de busca.

O que é um trator de esteiras e quais são os seus tipos?

Os crawlers são programas de computador automatizados que pesquisam na internet, frequentemente chamados de "robôs". Diferentes crawlers se especializam em web scraping, indexação e rastreamento de links. Eles usam esses dados para compilar páginas da web para resultados de pesquisa.

Qual é a finalidade dos rastreadores de mídias sociais?

Os rastreadores de mídias sociais ajudam a indexar e exibir conteúdo em múltiplas plataformas, melhorando a experiência do usuário e aumentando o engajamento.

Como posso proteger meu site de rastreadores maliciosos?

Implemente firewalls de aplicativos da web (WAF) e redes de distribuição de conteúdo (CDN) para proteger seu site contra rastreadores maliciosos.

O que é web crawling em SEO?

A indexação na web é o processo pelo qual os mecanismos de busca examinam e indexam páginas da web usando bots automatizados (rastreadores) para ajudar a classificá-las nos resultados da pesquisa.

Qual é o melhor rastreador web?

O Googlebot é o rastreador web mais poderoso, mas outros populares incluem o Bingbot, o Screaming Frog SEO Spider e o AhrefsBot.