In het huidige digitale landschap is het essentieel voor succes dat uw website vindbaar is voor zowel zoekmachines als menselijke gebruikers. Hoewel zoekwoorden en content cruciaal zijn voor SEO, wordt een ander belangrijk aspect vaak over het hoofd gezien: crawlbaarheid.

Met miljarden webpagina's en websites spelen zoekmachinebots een cruciale rol bij het verkennen en begrijpen van de enorme hoeveelheid beschikbare informatie. Deze bots, ook wel spiders genoemd, crawlen websites, volgen links en verzamelen gegevens om een index van URL's te creëren. Deze index vormt de basis voor zoekmachinealgoritmes om relevante resultaten te rangschikken en weer te geven.

Crawlability verwijst naar hoe effectief zoekmachinebots uw webpagina's kunnen scannen en indexeren. Stel dat uw site een lage crawlability heeft, met kapotte links en doodlopende pagina's. In dat geval kunnen zoekmachinecrawlers niet al uw waardevolle content bereiken en indexeren, wat resulteert in een lagere zichtbaarheid in de zoekresultaten.

Indexeerbaarheid is eveneens cruciaal, aangezien pagina's die niet geïndexeerd zijn, niet in de zoekresultaten verschijnen. Als zoekmachines een pagina niet in hun database hebben opgenomen, kan deze niet worden gerangschikt of aan gebruikers worden getoond.

Door crawlbaarheidsproblemen te begrijpen en aan te pakken, kunt u ervoor zorgen dat uw website toegankelijk is voor zowel zoekmachinebots als menselijke gebruikers. In deze handleiding bespreken we veelvoorkomende crawlbaarheidsproblemen, hun impact op SEOen, belangrijker nog, hoe u ze kunt oplossen. Laten we beginnen!

Wat? is een crawl-fout

De impact van crawlbaarheidsproblemen op SEO

Problemen met de crawlbaarheid van je website kunnen een aanzienlijke impact hebben op de SEO-prestaties. Wanneer zoekmachines crawlbaarheidsproblemen ondervinden, kan dit hun vermogen om je webpagina's effectief te vinden en te indexeren belemmeren. Hieronder lees je hoe crawlbaarheidsproblemen SEO beïnvloeden:

- Onvolledige indexering: Als zoekmachines uw webpagina's niet kunnen crawlen en indexeren vanwege crawlbaarheidsproblemen, verschijnen die pagina's mogelijk niet in de zoekresultaten. Dit leidt tot gemiste kansen op organische zichtbaarheid, waardoor de kans op organisch verkeer en potentiële conversies afneemt.

- Verminderd organisch verkeer: Wanneer uw pagina's niet worden geïndexeerd, zijn ze onzichtbaar voor zoekmachinegebruikers. Uw website ontvangt mogelijk minder organisch verkeer dan hij verdient, omdat hij niet in relevante zoekresultaten verschijnt. Problemen met de crawlbaarheid kunnen de stroom organisch verkeer naar uw website beperken.

- Verminderde zichtbaarheid en ranking: Zoekmachines gebruiken crawling en indexering om de inhoud en relevantie van uw webpagina's te begrijpen. Als crawlbaarheidsproblemen voorkomen dat zoekmachines uw content kunnen benaderen en analyseren, kan dit een negatieve invloed hebben op uw ranking. Zonder goede crawlbaarheid zullen uw pagina's mogelijk lager scoren in de zoekresultaten, wat resulteert in een verminderde zichtbaarheid en minder kansen om organisch verkeer aan te trekken.

- Gemiste conversiekansen: Problemen met de crawlbaarheid kunnen gebruikers ervan weerhouden uw website en de relevante pagina's te vinden. Als potentiële klanten uw site niet via zoekmachines kunnen vinden, kan dit leiden tot gemiste conversiekansen. Het verbeteren van de crawlbaarheid zorgt ervoor dat uw webpagina's toegankelijk zijn voor zoekmachinegebruikers, waardoor de kans op relevant verkeer en conversies toeneemt.

Weet dit: jouw 6-punten SEO-checklist voor 2023

Veelvoorkomende crawlbaarheidsproblemen en hoe je ze kunt oplossen

Crawlfouten kunnen de prestaties van uw website belemmeren, maar gelukkig zijn ze op te lossen. Laten we eens kijken naar enkele van de meest voorkomende crawlfouten en hoe u deze effectief kunt aanpakken.

Crawlbaarheidsprobleem 1: 404-fouten

404-fouten treden op wanneer een webpagina niet op de server kan worden gevonden. Hoewel deze fouten geen directe invloed hebben op de ranking in zoekmachines, kunnen ze wel de algehele gebruikerservaring negatief beïnvloeden als ze niet worden verholpen.

Oplossing: Om 404-fouten op te lossen, kunt u gebruikers van niet-bestaande URL's doorverwijzen naar overeenkomstige URL's. Bekijk de lijst met 404-fouten en stel redirects in naar de corresponderende pagina's op de live website. Als alternatief kunt u een HTTP-statuscode 410 weergeven om zoekmachines te laten weten dat de pagina permanent is verwijderd. Houd rekening met de specifieke oorzaak van de fout om de beste oplossing te bepalen.

Weet jehoe je 404-fouten in WordPress kunt oplossen?

Crawlbaarheidsprobleem 2: Geblokkeerde pagina's

Als bepaalde pagina's op uw website onbedoeld worden geblokkeerd voor zoekmachinebots, kan dit hun vermogen om die pagina's te indexeren belemmeren.

Oplossing: Controleer uw robots.txt-bestand en zorg ervoor dat het geen essentiële pagina's of gedeelten van uw website blokkeert. Pas het bestand indien nodig aan om ervoor te zorgen dat de gewenste pagina's correct kunnen worden gecrawld en geïndexeerd.

Crawlbaarheidsprobleem 3: Dubbele pagina's

Paginaduplicaten ontstaan wanneer meerdere URL's dezelfde inhoud laden, waardoor het voor zoekmachines moeilijker wordt om te bepalen welke pagina prioriteit moet krijgen. Dit kan leiden tot indexeringsproblemen en verspilling van crawlbudget aan repetitieve inhoud.

Oplossing: Gebruik de rel=canonical-tag om de originele of 'canonieke' pagina aan zoekmachines door te geven. Implementeer de tag op alle relevante pagina's om ervoor te zorgen dat zoekmachines indexeren de gewenste versie

Ontdek: crawlen, indexeren en rangschikken.

Crawlbaarheidsprobleem 4: Onjuiste pagina's in de sitemap

Onjuiste URL's in uw XML-sitemap kunnen zoekmachinebots misleiden en voorkomen dat ze belangrijke pagina's indexeren. Het is essentieel om een nauwkeurige en actuele sitemap te onderhouden.

Oplossing: Controleer en update uw XML-sitemapen verwijder verouderde of irrelevante URL's. Volg de richtlijnen voor grootte, codering en structuur van de sitemap om de effectiviteit ervan te garanderen.

Crawlbaarheidsprobleem 5: Gebrek aan interne links

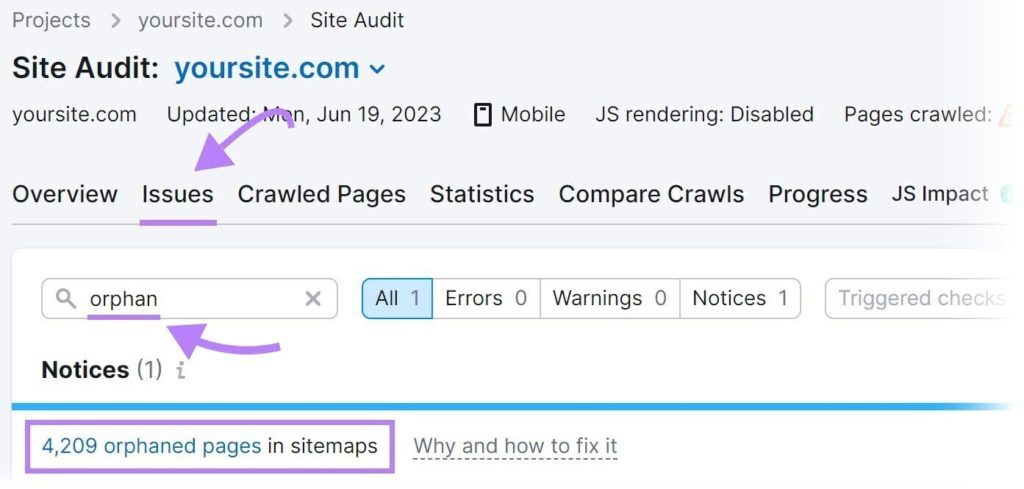

Pagina's zonder interne links kunnen de crawlbaarheid belemmeren, waardoor het voor zoekmachines moeilijk wordt om die pagina's te vinden en te indexeren.

Oplossing: Om dit probleem aan te pakken, identificeer je weespagina's (pagina's zonder interne links) en voeg je relevante interne links toe vanaf andere pagina's op je website.

Dit helpt zoekmachines om deze pagina's effectiever te navigeren en te crawlen, waardoor hun zichtbaarheid en indexering verbeteren. Het bijwerken van uw XML-sitemap met de nieuw gekoppelde pagina's draagt ook bij aan hun vindbaarheid.

Lees: Wat is interne linkbuilding en hoe helpt het je SEO?

Probleem 6 met crawlbaarheid: Lage laadsnelheid

Langzaam ladende pagina's dragen bij aan een slechte gebruikerservaring en beïnvloeden de crawlbaarheid. Snellere laadtijden zorgen ervoor dat zoekmachinebots efficiënter kunnen crawlen en verbeteren de zichtbaarheid in organische zoekresultaten.

Oplossing: Optimaliseer de laadsnelheid van uw website door CSS- en JavaScript- bestanden te minimaliseren, afbeeldingsbestanden te comprimeren, browsercaching te benutten en content delivery networks (CDN's) in te zetten. Meet regelmatig de laadsnelheid van uw site met tools zoals Google Lighthouse en voer de aanbevolen optimalisaties door.

Weet jewaarom je WordPress-website traag is?

Crawlbaarheidsprobleem 7: HTTP gebruiken in plaats van HTTPS

Gezien het belang van serverbeveiliging is de overstap van HTTP naar HTTPS cruciaal geworden. Zoekmachines geven de voorkeur aan HTTPS-pagina's en het gebruik van HTTP kan een negatieve invloed hebben op de crawlbaarheid en ranking in zoekresultaten.

Oplossing: Schaf een SSL-certificaat voor uw website en migreer naar HTTPS. Dit zorgt voor een veilige en versleutelde verbinding tussen gebruikers en uw website, waardoor de indexering door zoekmachines en de ranking in zoekmachines verbeteren.

Lees: Hoe krijg je een gratis SSL-certificaat voor WordPress?

Crawlbaarheidsprobleem 8: Website die niet geschikt is voor mobiele apparaten

Bij mobile-first indexing geven zoekmachines prioriteit aan de mobiele versie van uw website. Een niet-mobielvriendelijke website kan de crawlbaarheid belemmeren en een negatieve invloed hebben op uw ranking.

Oplossing: Pas responsive design toe, zorg ervoor dat uw website mobielvriendelijk is en optimaliseer pagina's voor zowel mobiele als desktopapparaten.

Leer meer overde beste WordPress-plugins voor snelheidsoptimalisatie.

Samenvatting

Problemen met de crawlbaarheid van uw website kunnen een aanzienlijke impact hebben op de SEO-prestaties. Veelvoorkomende problemen zoals 404-fouten, dubbele pagina's, fouten in robots.txt, onjuiste pagina's in de sitemap, een gebrek aan interne links, een trage laadsnelheid en het niet gebruiken van HTTPS kunnen voorkomen dat zoekmachines uw webpagina's effectief crawlen en indexeren.

Het goede nieuws is echter dat deze problemen met de crawlbaarheid opgelost kunnen worden. Door de voorgestelde oplossingen te implementeren, zoals het doorverwijzen van 404-fouten, het toepassen van URL-canonicalisatie, het zorgen voor een correct robots.txt-bestand, het bijwerken van sitemaps, het optimaliseren van de laadsnelheid, het migreren naar HTTPS en het toevoegen van interne links, kunt u de crawlbaarheid verbeteren, de zichtbaarheid in zoekmachines vergroten en uiteindelijk de SEO-prestaties van uw website verbeteren.

Onthoud dat crawlbaarheid cruciaal is voor zoekmachines om uw webpagina's te begrijpen en te rangschikken. Het aanpakken en oplossen van crawlbaarheidsproblemen creëert een solide basis voor zoekmachines om toegang te krijgen tot uw content en deze te indexeren, wat leidt tot een betere organische zichtbaarheid en meer websiteverkeer.

Los al je crawlbaarheidsproblemen op met Seahawk

Bent u het zat om met crawlbaarheidsproblemen te worstelen? Laat Seahawk uw website optimaliseren en zorg voor een vlotte indexering door zoekmachines.