Je website kan er perfect uitzien en toch slecht scoren in zoekresultaten. Dat is waar webcrawlers het verschil maken. Ze fungeren als de eerste bezoekers van je site en bepalen hoe zoekmachines je content beoordelen. Het handmatig controleren van pagina's op fouten kost tijd en vergroot de kans op fouten. Crawlers lossen dit snel op.

Webcrawlers scannen elke pagina, link en elk element om SEO-problemen op te sporen die de zichtbaarheid schaden. Ze helpen zoekmachines de structuur van uw site te begrijpen, content correct te indexeren en pagina's sneller te ranken. Van het beheren van het crawlbudget tot interne links en paginasnelheid: crawlers maken slimme SEO-beslissingen mogelijk.

In deze gids ontdek je de beste webcrawlers en hoe ze je SEO-strategie versterken.

Kort samengevat: De beste webcrawlers die SEO en websitezichtbaarheid verbeteren

- Webcrawlers scannen uw website om zoekmachines te helpen pagina's te indexeren, de structuur te begrijpen en de SEO-prestaties te verbeteren.

- Verschillende soorten crawlers dienen verschillende doeleinden, waaronder algemene, gerichte, incrementele, zoekmachine-, socialemedia- en SEO-toolcrawlers.

- Populaire crawlers zoals Googlebot, Bingbot, AhrefsBot en Screaming Frog helpen bij het identificeren van technische problemen, backlinks en optimalisatiehiaten.

- Goed crawlerbeheer met behulp van robots.txt, firewalls en CDN's beschermt uw site tegen kwaadwillende bots en zorgt tegelijkertijd voor een gezonde indexering.

Webcrawlers begrijpen

Webcrawlers, ook wel webcrawlerbots genoemd, zijn geautomatiseerde programma's die heen en weer over het web bewegen en content ordenen voor zoekmachineoptimalisatie, gegevensverzameling en monitoringdoeleinden.

Ze zijn essentieel voor het indexeren van webpagina's door zoekmachines zoals Google, Bingen andere, en voor het gebruik van een user-agent token om zichzelf te identificeren bij het bezoeken van websites.

Webcrawlers helpen ook bij het monitoren en optimaliseren van grote websites door SEO-problemen te identificeren, zoals dubbele content, broken links en onjuiste metatags. Ze analyseren de gecrawlde pagina's en zorgen ervoor dat pagina's correct gestructureerd zijn en opgenomen worden in XML-sitemaps voor indexering.

Inzicht in de werking van verschillende webcrawlers aan de hand van een uitgebreide lijst kan helpen bij het optimaliseren van landingspagina's voor zoekmachines.

Lees meer: Wat is een webcrawler?

Hoe werken webcrawlers?

Webcrawlers scannen systematisch webpagina's en indexeren de inhoud ervan. Deze wordt opgeslagen in de index van een zoekmachine, zodat de gegevens kunnen worden opgevraagd bij zoekopdrachten van gebruikers. Ze volgen links van de ene pagina naar de andere en houden zich aan het robots.txt-protocol, waardoor zoekmachinecrawlers kunnen bepalen welke URL's op uw site ze kunnen bezoeken.

Ontwikkelaars of marketeers kunnen in het robots.txt-bestand op hun website aangeven of ze bepaalde crawlers wel of niet toestaan op basis van hun user-agent token.

Inzicht in het crawlproces kan uw website toegankelijker en beter zichtbaar maken voor zoekmachines zoals Google en Bing. Deze kennis kan uiteindelijk de ranking en zichtbaarheid van uw website in de zoekresultaten verbeteren.

Wil je de SEO van je website verbeteren?

Laat onze SEO-experts uw rankings verbeteren en organisch verkeer genereren met bewezen technische en site-structuuroptimalisaties.

Meer informatie: Hoe los je het probleem op dat je video's niet geïndexeerd worden vanwege een nieuwe reden?

Soorten webcrawlers

Er zijn drie hoofdtypen webcrawlers:

- Algemene crawlers, ook wel webcrawlers of spiders genoemd, doorzoeken systematisch webpagina's om gegevens te verzamelen voor indexering door zoekmachines. Zoekmachines gebruiken deze informatie om zoekresultaten te rangschikken en weer te geven.

- Gerichte crawlers richten zich op specifieke soorten content of websites. Ze zijn ontworpen om informatie te verzamelen over een bepaald onderwerp of domein.

- Incrementele crawlers doorzoeken alleen webpagina's die sinds de laatste crawl zijn bijgewerkt. Hierdoor kunnen ze efficiënt nieuwe of gewijzigde content verzamelen zonder de hele website opnieuw te hoeven crawlen.

Gerichte crawlers daarentegen verzamelen webpagina's die voldoen aan een specifieke eigenschap of een specifiek onderwerp, waarbij ze strategisch prioriteit geven aan de crawlgrens en een verzameling relevante pagina's bijhouden.

Incrementele crawlers bezoeken en crawlen URL's opnieuw om de gecrawlde gegevens actueel te houden, waardoor ze ideaal zijn voor scenario's die actuele, consistente gegevens vereisen.

Gerelateerd: Hoe zoekmachines werken: crawlen, indexeren en rangschikken

De 14 belangrijkste webcrawlers die je moet kennen

Deze uitgebreide lijst met webcrawlers beschrijft de meest voorkomende webcrawlers en hun rol in zoekmachine-indexering, gegevensverzameling en -analyse. Deze crawlers omvatten:

- Googlebot

- Bingbot

- Yandex Bot

- Google Bard

- Openai ChatGPT

- Facebook-crawler

- Twitterbot

- Pinterestbot

- AhrefsBot

- SemrushBot

- Moz's campagne-crawler Rogerbot

- Apache-noot

- Schreeuwende Kikker

- HTTrack

We zullen elk van deze crawlers in de lijst nader bekijken, met de nadruk op hun unieke rollen en functionaliteiten.

Zie ook: Beste tools voor website-audits voor SEO

Googlebot

Googlebot, ook wel bekend als de user agent Googlebot, is de belangrijkste webcrawler van Google. Het is verantwoordelijk voor het indexeren en weergeven van pagina's voor de zoekmachine. Het crawlt Google-websites door links te volgen, webpagina's te scannen en zich te houden aan de regels in robots.txt, waardoor de inhoud van websites toegankelijk is voor de zoekmachine van Google.

Het is essentieel om vertrouwd te zijn met Googlebot, aangezien het crawlproces ervan de zoekmachinepositie en zichtbaarheid van uw website aanzienlijk kan verbeteren.

Bingbot

Bingbot is Microsofts webcrawler voor de Bing-zoekmachine, met een mobielgerichte indexeringsaanpak. Het richt zich op het indexeren van de mobiele versie van websites en benadrukt mobielvriendelijke content in zoekresultaten om tegemoet te komen aan het mobielgerichte karakter van modern internetgebruik.

Het is vergelijkbaar met Googlebot, en de toonaangevende Chinese zoekmachine is een cruciale crawler voor diegenen die willen dat hun content vindbaar is via meerdere zoekmachines.

Bekijk ook: De beste digitale marketingstrategieën voor lokale bedrijven

Yandex Bot

Yandex Bot is de webcrawler van de Russische zoekmachine Yandex, die prioriteit geeft aan Cyrillisch schrift en Russischtalige content. Het is verantwoordelijk voor het crawlen en indexeren van voornamelijk Russische websites, die specifiek zijn afgestemd op de behoeften van het Russischsprekende publiek.

Yandex Bot is een essentiële webcrawler voor diegenen die zich richten op de Russische markt om hun content te optimaliseren.

Google Bard

Google Bard is een webcrawler voor de generatieve API's Bard en Vertex AI van Google, waarmee webuitgevers hun website kunnen verbeteren.

Het kan webuitgevers helpen bij het beheren van siteverbeteringen door nauwkeurigere antwoorden te bieden, te integreren met Google-apps en -services en uitgevers in staat te stellen AI-trainingsgegevens te reguleren.

Het verbetert de zichtbaarheid van bronmateriaal en biedt authentieke bronvermeldingen in reacties, waardoor het een waardevol hulpmiddel is voor webuitgevers die hun content willen optimaliseren.

Ontdek. hoe je van Blogger naar WordPress migreert

OpenAI ChatGPT

van OpenAI De webcrawler de mogelijkheden van de AI aanzienlijk, wat resulteert in een betere gebruikerservaring en nauwkeurigere antwoorden van de AI-gestuurde chatbot.

Het is een webcrawler die door OpenAI wordt gebruikt voor het trainen en verbeteren van hun taalmodellen. GPTBot verzamelt openbaar beschikbare gegevens van websites om modellen voor kunstmatige intelligentie, zoals GPT-4, te verbeteren.

Lees verder: Zo bekijk je pagina's uit de Google-cache

Sociale media-crawlers

Socialmediacrawlers verbeteren de gebruikerservaring en betrokkenheid op diverse platformen. Ze indexeren en tonen gedeelde content op platformen zoals Facebook, Twitter en Pinterest, waardoor gebruikers visueel aantrekkelijke en informatieve voorbeelden van webcontent te zien krijgen.

We bespreken nu drie bekende social media crawlers: Facebook Crawler, Twitterbot en Pinterestbot.

Facebook-crawler

Facebook Crawler verzamelt website-informatie die op het platform wordt gedeeld en genereert uitgebreide voorbeelden, waaronder een titel, een korte beschrijving en een miniatuurafbeelding.

Hierdoor kunnen gebruikers snel een indruk krijgen van de gedeelde inhoud voordat ze op de link klikken, wat de gebruikerservaring verbetert en de betrokkenheid stimuleert.

Facebook Crawler optimaliseert gedeelde content voor het platform, waardoor gebruikers een visueel aantrekkelijke en informatieve browse-ervaring krijgen.

Twitterbot

Twitterbot, de webcrawler van Twitter, indexeert en toont gedeelde URL's om previews van webcontent op het platform weer te geven.

Door previewkaarten te genereren met titels, beschrijvingen en afbeeldingen, biedt Twitterbot gebruikers een momentopname van gedeelde content, wat de betrokkenheid en interactie van gebruikers stimuleert.

Twitterbot optimaliseert content voor het Twitter-platform, waardoor gebruikers gedeelde content gemakkelijker kunnen ontdekken en ermee kunnen interageren.

Pinterestbot

Het is een webcrawler voor het visueel georiënteerde sociale platform, gericht op het indexeren van afbeeldingen en content voor weergave op het platform. Pinterestbot crawlt en indexeert afbeeldingen, waardoor gebruikers visuele inspiratie kunnen ontdekken en opslaan via pins en boards.

De belangrijkste functie ervan is om gebruikers een visueel aantrekkelijke en overzichtelijke browse-ervaring te bieden, waardoor ze content kunnen verkennen en ermee kunnen interageren die is afgestemd op hun interesses.

Ontdek. waarom je WordPress-website traag is

Lijst met SEO-toolcrawlers

SEO-crawlers zijn essentieel voor het verzamelen van gegevens voor websiteprestatieanalyse en -optimalisatie op diverse SEO-platformen.

Deze crawlers bieden waardevolle inzichten in de website-structuur, backlinksen gebruikersbetrokkenheid, waardoor website-eigenaren en marketeers weloverwogen beslissingen kunnen nemen om hun online aanwezigheid te verbeteren.

We gaan nu drie populaire SEO-crawlers bekijken: AhrefsBot, SemrushBot en Moz's Campaign Crawler, Rogerbot.

AhrefsBot

AhrefsBot is een webcrawler die links indexeert voor de Ahrefs SEO-software. Het bezoekt dagelijks 6 miljard websites, waarmee het na Googlebot de meest actieve crawler is.

AhrefsBot doorzoekt websites om informatie te verzamelen over backlinks, zoekwoorden en andere SEO-factoren. Deze informatie wordt gebruikt om optimalisatiebeslissingen te onderbouwen.

AhrefsBot is een waardevolle tool voor iedereen die de zoekmachinepositie en zichtbaarheid van zijn website wil verbeteren. Het is ook geschikt voor website-eigenaren, SEO-professionals en marketeers.

SemrushBot

SemrushBot is een webcrawlerbot die wordt gebruikt door Semrush, een toonaangevende aanbieder van SEO-software. De bot verzamelt en catalogiseert websitegegevens voor gebruik door klanten op hun platform. SemrushBot genereert een lijst met URL's van webpagina's, bezoekt deze en slaat bepaalde hyperlinks op voor toekomstig gebruik.

De gegevens van SemrushBot worden gebruikt in verschillende Semrush-tools, waaronder:

- Openbare backlink zoekmachine

- Site-audittool

- Backlink-audittool

- Linkbuildingtool

- Schrijfassistent

Deze tools bieden waardevolle inzichten voor het optimaliseren van websiteprestaties en SEO-strategieën.

Moz's campagne-crawler Rogerbot

Moz's Campaign Crawler Rogerbot is een webcrawler die speciaal is ontworpen voor Moz Pro Campaign-siteaudits. Deze crawler wordt aangeboden door Moz, een toonaangevende website voor SEO.

Het verzamelt content voor Moz Pro Campaign-audits en houdt zich aan de robots.txt-regels om te zorgen dat de website voldoet aan de voorkeuren van de eigenaar.

Rogerbot is een waardevolle tool voor website-eigenaren en marketeers die de zoekmachinepositie en zichtbaarheid van hun website willen verbeteren. Het maakt gebruik van uitgebreide website-audits en datagestuurde optimalisatiestrategieën.

Gerelateerd: Optimale SEO op WordPress: een uitgebreide handleiding

Open Source Crawlers

Open-source crawlers bieden flexibiliteit en schaalbaarheid voor het crawlen van specifieke websites of grootschalige internetcrawlers. Deze crawlers kunnen worden aangepast aan specifieke behoeften.

Dit maakt ze een waardevolle bron voor webontwikkelaars en SEO-professionals die de prestaties van hun website willen optimaliseren.

We gaan nu dieper in op drie open-source crawlers: Apache Nutch, Screaming Frog en HTTrack.

Apache-noot

Apache Nutch is ideaal voor webontwikkelaars en SEO-professionals die een aanpasbare webcrawler nodig hebben die aan hun specifieke behoeften voldoet, of het nu gaat om het crawlen van een bepaalde website of het uitvoeren van grootschalige internetcrawls.

- Een flexibele en schaalbare open-source webcrawler

- Wordt gebruikt voor het crawlen van specifieke websites of het hele internet

- Gebaseerd op Apache Hadoop-datastructuren

- Het kan tot in detail worden geconfigureerd.

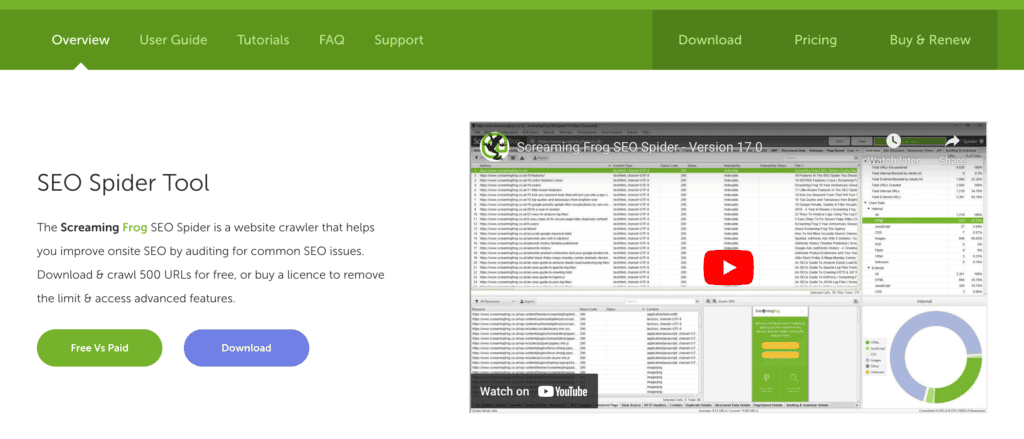

Schreeuwende Kikker

Screaming Frog is een desktoptool voor het crawlen van websites vanuit een SEO-perspectief. Het presenteert elementen van de website in tabbladen voor realtime analyse en filtering. Het staat bekend om zijn gebruiksvriendelijke interface en de snelheid waarmee het technische resultaten levert die de Google-crawl optimaliseren.

Screaming Frog is een onmisbare bron voor webontwikkelaars en SEO-professionals die de prestaties van hun websites willen verbeteren door middel van uitgebreide site-audits en datagestuurde optimalisatiestrategieën.

HTTrack

HTTrack is gratis software waarmee je websites kunt downloaden en kopiëren. Het ondersteunt meerdere besturingssystemen en biedt veel functies. Het werkt door middel van een webcrawler die de bestanden van de website ophaalt en organiseert in een structuur die de oorspronkelijke relatieve linkstructuur van de site behoudt.

Dit stelt gebruikers in staat om de gedownloade website offline te bekijken met elke webbrowser. HTTrack is een waardevol hulpmiddel voor website-eigenaren en marketeers die een lokale kopie van een website willen maken voor offline gebruik of replicatie.

Meer informatie: Migreer uw website naar WordPress

Uw website beschermen tegen kwaadwillende crawlers

Het beschermen van uw website tegen kwaadaardige crawlers is essentieel om fraude, aanvallen en diefstal van gegevens te voorkomen.

Het identificeren en blokkeren van deze schadelijke crawlers kan de inhoud van uw website, gebruikersgegevens en online aanwezigheid beschermen. Het zorgt voor een veilige en betrouwbare browse-ervaring voor uw bezoekers.

We bespreken nu technieken om kwaadaardige crawlers te identificeren en methoden om te voorkomen dat ze toegang krijgen tot uw website.

Het identificeren van kwaadaardige crawlers

Het identificeren van kwaadaardige crawlers omvat het controleren van user agents, waaronder de volledige user agent string, de user agent string voor desktops, de user agent string en IP-adressen in site records.

Je kunt legitieme en kwaadaardige webcrawlers van elkaar onderscheiden door deze kenmerken te analyseren. Dit helpt je om de juiste maatregelen te nemen om je website te beschermen tegen potentiële bedreigingen.

Door regelmatig de toegangslogboeken van uw website te controleren en beveiligingsmaatregelen te implementeren, kunt u een veilige online omgeving voor uw gebruikers garanderen.

Blokkeertechnieken

Technieken zoals het aanpassen van machtigingen via robots.txt en het implementeren van beveiligingsmaatregelen, zoals webapplicatiefirewalls (WAF) en content delivery networks (CDN), kunnen kwaadaardige crawlers blokkeren.

Het gebruik van de 'Disallow'-richtlijn, gevolgd door de user-agentnaam van de crawler die u wilt blokkeren in uw robots.txt-bestand, is een effectieve manier om specifieke webcrawlers te blokkeren.

Daarnaast kan de implementatie van een WAF een website beschermen tegen kwaadwillende crawlers door het verkeer te filteren voordat het de site bereikt. Een CDN kan dit daarentegen tegengaan door verzoeken door te sturen naar de server die zich het dichtst bij de locatie van de gebruiker bevindt, waardoor het risico op bot-aanvallen op de site wordt verkleind.

Door deze blokkeringstechnieken toe te passen, kunt u uw website beschermen tegen schadelijke crawlers en een veilige browse-ervaring voor uw bezoekers garanderen.

Gerelateerd: Beste aanbieders van WordPress-beveiligingsdiensten

Samenvatting

Kortom, webcrawlers spelen een essentiële rol in het digitale landschap, omdat ze webpagina's indexeren, gegevens verzamelen en zoekmachines in staat stellen om kwalitatief hoogwaardige resultaten te leveren.

Inzicht in de verschillende soorten webcrawlers en hun functies kan waardevolle informatie opleveren voor het optimaliseren van uw website en het behouden van een voorsprong in de digitale wereld.

Door de juiste beveiligingsmaatregelen en blokkeringstechnieken toe te passen, kunt u uw website beschermen tegen kwaadwillende crawlers en een veilige online omgeving voor uw gebruikers creëren.

Veelgestelde vragen

Wat zijn enkele voorbeelden van crawlers?

Voorbeelden van webcrawlers zijn Googlebot (desktop- en mobiele versie), Bingbot, DuckDuckBot, Yahoo Slurp, YandexBot, Baiduspider en ExaBot.

Wat is een crawler-zoekmachine?

Een crawler, ook wel bekend als spider, robot of bot, is een geautomatiseerd programma dat systematisch webpagina's doorzoekt om ze te indexeren voor zoekmachines.

Wat is een crawler en welke typen bestaan er?

Crawlers zijn geautomatiseerde computerprogramma's die het internet afzoeken, vaak ook wel 'robots' genoemd. Verschillende crawlers zijn gespecialiseerd in het scrapen van webpagina's, het indexeren ervan en het volgen van links. Ze gebruiken deze gegevens om webpagina's samen te stellen voor zoekresultaten.

Wat is het doel van social media crawlers?

Socialmediacrawlers helpen bij het indexeren en weergeven van content op meerdere platforms, waardoor de gebruikerservaring verbetert en de betrokkenheid toeneemt.

Hoe kan ik mijn website beschermen tegen kwaadwillende crawlers?

Implementeer webapplicatiefirewalls (WAF) en content delivery networks (CDN) om uw website te beschermen tegen kwaadwillende crawlers.

Wat is webcrawling in SEO?

Webcrawling is het proces waarbij zoekmachines webpagina's scannen en indexeren met behulp van geautomatiseerde bots (crawlers) om ze hoger in de zoekresultaten te plaatsen.

Wat is de beste webcrawler?

Googlebot is de krachtigste webcrawler, maar andere populaire crawlers zijn onder andere Bingbot, Screaming Frog SEO Spider en AhrefsBot.