Ihre Website kann perfekt aussehen und trotzdem in den Suchergebnissen schlecht abschneiden. Hier kommen Webcrawler ins Spiel. Sie fungieren als erste Besucher Ihrer Website und bestimmen, wie Suchmaschinen Ihre Inhalte bewerten. Die manuelle Fehlerprüfung von Seiten ist zeitaufwendig und fehleranfällig. Crawler lösen dieses Problem schnell.

Webcrawler durchsuchen jede Seite, jeden Link und jedes Asset, um SEO-Probleme aufzudecken, die die Sichtbarkeit beeinträchtigen. Sie helfen Suchmaschinen, Ihre Website-Struktur zu verstehen, Inhalte korrekt zu indexieren und Seiten schneller zu ranken. Von der Kontrolle des Crawl-Budgets über die interne Verlinkung bis hin zur Seitenladezeit – Crawler unterstützen intelligente SEO-Entscheidungen.

In diesem Leitfaden erfahren Sie, welche Webcrawler die besten sind und wie diese Ihre SEO-Strategie stärken.

Kurz gesagt: Die besten Webcrawler für SEO und Website-Sichtbarkeit

- Webcrawler scannen Ihre Website, um Suchmaschinen dabei zu helfen, Seiten zu indexieren, die Struktur zu verstehen und die SEO-Performance zu verbessern.

- Verschiedene Crawler-Typen dienen unterschiedlichen Zwecken, darunter allgemeine, fokussierte, inkrementelle, Suchmaschinen-, Social-Media- und SEO-Tool-Crawler.

- Beliebte Crawler wie Googlebot, Bingbot, AhrefsBot und Screaming Frog helfen dabei, technische Probleme, Backlinks und Optimierungslücken zu identifizieren.

- Durch die korrekte Verwaltung von Crawlern mithilfe von robots.txt, Firewalls und CDNs wird Ihre Website vor schädlichen Bots geschützt und gleichzeitig eine gesunde Indexierung unterstützt.

Webcrawler verstehen

Webcrawler, auch bekannt als Webcrawler-Bots, sind automatisierte Programme, die sich im Web vor- und zurückbewegen und Inhalte für Suchmaschinenoptimierung, Datenerfassung und Überwachung organisieren.

Sie sind unerlässlich für die Indexierung von Webseiten durch Suchmaschinen wie Google , Bing und andere sowie für die Verwendung eines User-Agent-Tokens zur Identifizierung beim Zugriff auf Webseiten.

Webcrawler helfen zudem bei der Überwachung und Optimierung großer Websites, indem sie SEO-Probleme wie doppelten Inhalt, defekte Links und fehlerhafte Meta-Tags identifizieren. Sie analysieren die gecrawlten Seiten und stellen sicher, dass diese korrekt strukturiert sind und in XML-Sitemaps zur Indexierung aufgenommen werden.

Das Verständnis der Funktionsweise verschiedener Webcrawler anhand einer umfassenden Liste kann helfen, Landingpages für Suchmaschinen zu optimieren.

Weiterlesen: Was ist ein Webcrawler?

Wie Webcrawler funktionieren

Webcrawler durchsuchen systematisch Webseiten, indexieren deren Inhalte und speichern sie im Index einer Suchmaschine, um sie bei Suchanfragen von Nutzern abzurufen. Sie folgen Links von einer Seite zur anderen und halten sich an das robots.txt-Protokoll, wodurch Suchmaschinen-Crawler feststellen können, welche URLs auf Ihrer Website sie aufrufen dürfen.

Entwickler oder Marketingfachleute können in ihrer robots.txt-Datei auf ihrer Website festlegen, ob sie bestimmte Crawler anhand ihres User-Agent-Tokens zulassen oder ablehnen.

Das Verständnis des Crawling-Prozesses kann Ihre Website für Suchmaschinen wie Google und Bing zugänglicher und sichtbarer machen. Dieses Wissen kann letztendlich das Ranking und die Sichtbarkeit Ihrer Website in den Suchergebnissen verbessern.

Möchten Sie die Suchmaschinenoptimierung Ihrer Website verbessern?

Unsere SEO-Experten verbessern Ihr Ranking und steigern den organischen Traffic durch bewährte technische Optimierungen und Optimierungen der Website-Struktur.

Mehr erfahren: So beheben Sie das Problem „Neuer Grund verhindert die Indexierung Ihrer Videos“

Arten von Webcrawlern

Es gibt drei Haupttypen von Webcrawlern:

- Allgemeine Crawler , auch Webcrawler oder Spider genannt, durchsuchen systematisch Webseiten, um Daten für die Suchmaschinenindexierung zu sammeln. Suchmaschinen nutzen diese Informationen, um Suchergebnisse zu ordnen und anzuzeigen.

- Fokussierte Crawler zielen auf bestimmte Arten von Inhalten oder Websites ab. Sie sind darauf ausgelegt, Informationen zu einem bestimmten Thema oder einer bestimmten Domäne zu sammeln.

- Inkrementelle Crawler durchsuchen nur Webseiten, die seit dem letzten Crawl aktualisiert wurden. Dadurch können sie neue oder geänderte Inhalte effizient erfassen, ohne die gesamte Website erneut durchsuchen zu müssen.

Fokussierte Crawler hingegen sammeln Webseiten, die einer bestimmten Eigenschaft oder einem bestimmten Thema entsprechen, priorisieren strategisch den Crawling-Bereich und pflegen eine Sammlung relevanter Seiten.

Inkrementelle Crawler besuchen und durchsuchen URLs erneut, um die gecrawlten Daten auf dem neuesten Stand zu halten. Dadurch eignen sie sich ideal für Szenarien, die aktualisierte und konsistente Daten erfordern.

Verwandtes Thema: Wie Suchmaschinen funktionieren: Crawling, Indexierung und Ranking

Die 14 besten Webcrawler, die Sie kennen sollten

Diese umfassende Liste von Webcrawlern beschreibt die gängigsten Webcrawler und hebt deren Rolle bei der Suchmaschinenindexierung, Datenerfassung und -analyse hervor. Zu diesen Crawlern gehören:

- Googlebot

- Bingbot

- Yandex-Bot

- Google Bard

- Openai ChatGPT

- Facebook-Crawler

- Twitterbot

- Pinterestbot

- AhrefsBot

- SemrushBot

- Moz's Campaign Crawler Rogerbot

- Apache Nutch

- Schreiender Frosch

- HTTrack

Wir werden jeden einzelnen dieser Crawler in der Liste genauer betrachten und uns dabei auf ihre jeweiligen Rollen und Funktionen konzentrieren.

Siehe auch : Die besten Website-Audit-Tools für SEO

Googlebot

Googlebot, auch bekannt als User-Agent Googlebot , ist der primäre Webcrawler von Google. Er ist für das Indexieren und Rendern von Seiten für die Suchmaschine zuständig. Er durchsucht Google-Websites, indem er Links folgt, Webseiten scannt und die robots.txt-Regeln befolgt, um sicherzustellen, dass die Website-Inhalte für die Google-Suchmaschine zugänglich sind.

Kenntnisse über Googlebot sind unerlässlich, da dessen Crawling-Prozess die Suchmaschinenplatzierung und Sichtbarkeit Ihrer Website erheblich verbessern kann.

Bingbot

Bingbot ist der Webcrawler von Microsoft für die Bing-Suchmaschine und verfolgt einen Mobile-First-Indexierungsansatz. Er konzentriert sich auf die Indexierung der mobilen Version von Websites und hebt mobilfreundliche Inhalte in den Suchergebnissen hervor, um dem mobilen Surfverhalten moderner Nutzer gerecht zu werden.

Ähnlich wie Googlebot ist der führende chinesische Suchmaschinen-Crawler für diejenigen von entscheidender Bedeutung, die möchten, dass ihre Inhalte über mehrere Suchmaschinen hinweg auffindbar sind.

Schauen Sie sich das an : Die besten digitalen Marketingstrategien für lokale Unternehmen

Yandex-Bot

Yandex Bot ist der Webcrawler der russischen Suchmaschine Yandex und priorisiert Inhalte in kyrillischer Schrift und russischer Sprache. Er ist für das Crawlen und Indexieren überwiegend russischer Webseiten zuständig und geht dabei speziell auf die Bedürfnisse des russischsprachigen Publikums ein.

Yandex Bot ist ein unverzichtbarer Webcrawler für diejenigen, die den russischen Markt anvisieren, um ihre Inhalte zu optimieren.

Google Bard

Google Bard ist ein Webcrawler für die generativen KI-APIs Bard und Vertex von Google, der Webseitenbetreibern bei der Verwaltung von Website-Verbesserungen hilft.

Es kann Webseitenbetreibern bei der Verwaltung von Website-Verbesserungen helfen, indem es präzisere Antworten liefert, die Integration mit Google-Apps und -Diensten ermöglicht und es den Betreibern erlaubt, KI-Trainingsdaten zu steuern.

Es verbessert die Sichtbarkeit der Quellinhalte und liefert authentische Zitate in den Antworten, was es zu einem wertvollen Werkzeug für Web-Publisher macht, die ihre Inhalte optimieren möchten.

Erfahren Sie : So migrieren Sie von Blogger zu WordPress

OpenAI ChatGPT

Webcrawler von OpenAI die Fähigkeiten der KI erheblich, was zu einem besseren Benutzererlebnis und genaueren Antworten des KI-gesteuerten Chatbots führt.

Es handelt sich um einen Webcrawler, der von OpenAI zum Trainieren und Verbessern seiner Sprachmodelle eingesetzt wird. GPTBot sammelt öffentlich zugängliche Daten von Websites, um Modelle der künstlichen Intelligenz wie GPT-4 zu optimieren.

Weiterlesen : So zeigen Sie im Google-Cache gespeicherte Seiten an

Social-Media-Crawler

Social-Media-Crawler verbessern die Nutzererfahrung und das Engagement auf verschiedenen Plattformen. Sie indexieren und zeigen geteilte Inhalte auf Plattformen wie Facebook, Twitter und Pinterest an und bieten Nutzern visuell ansprechende, informative Vorschauen von Webinhalten.

Wir werden nun drei bemerkenswerte Social-Media-Crawler besprechen: Facebook Crawler, Twitterbot und Pinterestbot.

Facebook-Crawler

Der Facebook Crawler sammelt Website-Informationen, die auf der Plattform geteilt werden, und generiert aussagekräftige Vorschauen, einschließlich Titel, Kurzbeschreibung und Miniaturbild.

Dadurch erhalten die Nutzer einen schnellen Überblick über die geteilten Inhalte, bevor sie auf den Link klicken. Dies verbessert das Nutzererlebnis und fördert die Interaktion.

Der Facebook Crawler optimiert geteilte Inhalte für die Plattform und bietet Nutzern ein visuell ansprechendes und informatives Browsing-Erlebnis.

Twitterbot

Twitterbot , der Webcrawler von Twitter, indexiert und zeigt geteilte URLs an, um Webinhaltsvorschauen auf der Plattform anzuzeigen.

Durch die Generierung von Vorschaukarten mit Titeln, Beschreibungen und Bildern bietet Twitterbot den Nutzern eine Momentaufnahme der geteilten Inhalte und fördert so die Nutzerinteraktion.

Twitterbot optimiert Inhalte für die Twitter-Plattform und erleichtert es Nutzern, geteilte Inhalte zu entdecken und mit ihnen zu interagieren.

Pinterestbot

Pinterestbot ist ein Webcrawler für die visuell orientierte Social-Media-Plattform Pinterest, der Bilder und Inhalte indexiert, um sie auf der Plattform anzuzeigen. Pinterestbot durchsucht und indexiert Bilder und ermöglicht es Nutzern so, visuelle Inspirationen über Pins und Pinnwände zu entdecken und zu speichern.

Seine Hauptfunktion besteht darin, den Nutzern ein visuell beeindruckendes und übersichtliches Browsererlebnis zu bieten, das es ihnen ermöglicht, auf ihre Interessen zugeschnittene Inhalte zu erkunden und sich mit ihnen auseinanderzusetzen.

Erfahren Sie : Warum ist Ihre WordPress-Installation langsam?

Liste der SEO-Tool-Crawler

SEO-Tool-Crawler sind unerlässlich, um Daten für die Website-Performance-Analyse und -Optimierung auf verschiedenen SEO-Plattformen zu sammeln.

Diese Crawler liefern wertvolle Einblicke in die Website-Struktur, Backlinks und die Nutzerinteraktion und helfen Website-Betreibern und Marketingfachleuten, fundierte Entscheidungen zur Verbesserung ihrer Online-Präsenz zu treffen.

Wir werden nun drei beliebte SEO-Tool-Crawler genauer betrachten: AhrefsBot, SemrushBot und den Kampagnen-Crawler von Moz, Rogerbot.

AhrefsBot

AhrefsBot ist ein Webcrawler, der Links für die SEO-Software Ahrefs indexiert. Er besucht täglich 6 Milliarden Websites und ist damit nach Googlebot der zweitaktivste Crawler.

AhrefsBot durchsucht Websites, um Informationen über Backlinks, Keywords und andere SEO-Faktoren zu sammeln. Diese Informationen dienen als Grundlage für Optimierungsentscheidungen.

AhrefsBot ist ein wertvolles Tool für alle, die das Suchmaschinenranking und die Sichtbarkeit ihrer Website verbessern möchten. Dazu gehören Website-Betreiber, SEO-Experten und Marketingfachleute.

SemrushBot

SemrushBot ist ein Webcrawler-Bot von Semrush, einem führenden Anbieter von SEO-Software. Er dient dazu, Website-Daten zu erfassen und zu katalogisieren, die Kunden auf der Semrush-Plattform nutzen können. Dazu erstellt er eine Liste von Webseiten-URLs, besucht diese und speichert bestimmte Hyperlinks für spätere Besuche.

Die Daten von SemrushBot werden in mehreren Semrush-Tools verwendet, darunter:

- Öffentliche Backlink-Suchmaschine

- Website-Audit-Tool

- Backlink-Audit-Tool

- Linkbuilding-Tool

- Schreibassistent

Diese Tools liefern wertvolle Erkenntnisse zur Optimierung der Website-Performance und der SEO-Strategien.

Moz's Campaign Crawler Rogerbot

Der Kampagnen-Crawler Rogerbot von Moz ist ein Webcrawler, der speziell für die Website-Audits von Moz Pro Campaign entwickelt wurde. Er wird von Moz, dem führenden SEO-Portal, bereitgestellt.

Es sammelt Inhalte für Moz Pro Kampagnen-Audits und hält sich an die robots.txt-Regeln, um die Einhaltung der Präferenzen des Website-Inhabers zu gewährleisten.

Rogerbot ist ein wertvolles Tool für Website-Betreiber und Marketingfachleute, die das Suchmaschinenranking und die Sichtbarkeit ihrer Website verbessern möchten. Es nutzt umfassende Website-Audits und datenbasierte Optimierungsstrategien.

Siehe auch: Optimale Suchmaschinenoptimierung auf WordPress: Ein umfassender Leitfaden

Open-Source-Crawler

Open-Source-Webcrawler bieten Flexibilität und Skalierbarkeit für das Crawling einzelner Websites oder großflächiger Internet-Analysen. Diese Crawler lassen sich an spezifische Bedürfnisse anpassen.

Das macht sie zu einer wertvollen Ressource für Webentwickler und SEO-Experten, die die Leistung ihrer Website optimieren möchten.

Wir werden uns nun mit drei Open-Source-Crawlern befassen: Apache Nutch, Screaming Frog und HTTrack.

Apache Nutch

Apache Nutch ist ideal für Webentwickler und SEO-Experten, die einen anpassbaren Webcrawler benötigen, der ihren spezifischen Bedürfnissen gerecht wird, sei es das Crawlen einer bestimmten Website oder das Durchführen von groß angelegten Internet-Crawls.

- Ein flexibler und skalierbarer Open-Source-Webcrawler

- Wird zum Durchsuchen bestimmter Websites oder des gesamten Internets verwendet

- Basierend auf Apache Hadoop-Datenstrukturen

- Es kann detailliert konfiguriert werden.

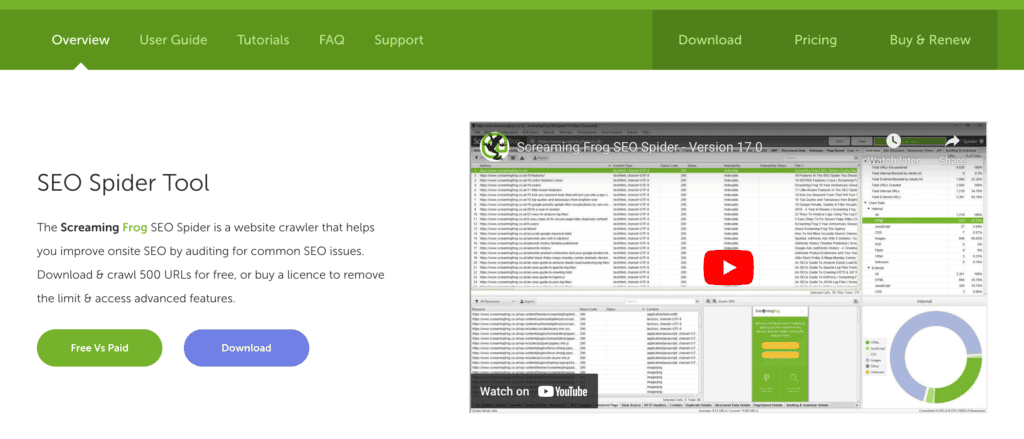

Schreiender Frosch

Screaming Frog ist ein Desktop-Tool zum Crawlen von Websites aus SEO-Perspektive. Es präsentiert die Website-Elemente in Tabs zur Echtzeitanalyse und Filterung. Es ist bekannt für seine benutzerfreundliche Oberfläche und die schnelle Bereitstellung technischer Ergebnisse, die die Crawling-Rate von Google optimieren.

Screaming Frog ist eine unverzichtbare Ressource für Webentwickler und SEO-Experten, die die Leistung ihrer Websites durch umfassende Website-Audits und datengestützte Optimierungsstrategien verbessern möchten.

HTTrack

HTTrack ist eine kostenlose Software zum Herunterladen und Spiegeln von Webseiten. Sie unterstützt verschiedene Systeme und bietet zahlreiche Funktionen. HTTrack arbeitet mit einem Webcrawler, der die Dateien der Webseite erfasst und sie so strukturiert, dass die ursprüngliche Linkstruktur erhalten bleibt.

Dies ermöglicht es Nutzern, die heruntergeladene Website offline mit jedem beliebigen Webbrowser zu nutzen. HTTrack ist ein wertvolles Tool für Website-Betreiber und Marketingfachleute, die eine lokale Kopie einer Website zum Offline-Browsing oder zur Replikation erstellen möchten.

Mehr erfahren : Ihre Website zu WordPress migrieren

Schutz Ihrer Website vor schädlichen Crawlern

Der Schutz Ihrer Website vor bösartigen Crawlern ist unerlässlich, um Betrug, Angriffe und Datendiebstahl zu verhindern.

Durch das Erkennen und Blockieren dieser schädlichen Crawler können Sie die Inhalte Ihrer Website, die Nutzerdaten und Ihre Online-Präsenz schützen. Dies sorgt für ein sicheres Surferlebnis Ihrer Besucher.

Wir werden nun Techniken zur Identifizierung schädlicher Crawler und Methoden zur Blockierung ihres Zugriffs auf Ihre Website besprechen.

Identifizierung schädlicher Webcrawler

Zur Identifizierung bösartiger Crawler gehört die Überprüfung der User-Agents, einschließlich des gesamten User-Agent-Strings, des User-Agent-Strings Desktop, des User-Agent-Strings und der IP-Adressen in den Site-Datensätzen.

Sie können legitime und schädliche Webcrawler anhand dieser Merkmale unterscheiden. Dies hilft Ihnen, geeignete Maßnahmen zum Schutz Ihrer Website vor potenziellen Bedrohungen zu ergreifen.

Die regelmäßige Überwachung der Zugriffsprotokolle Ihrer Website und die Implementierung von Sicherheitsmaßnahmen können dazu beitragen, eine sichere Online-Umgebung für Ihre Benutzer zu gewährleisten.

Blocktechniken

Techniken wie die Anpassung von Berechtigungen über robots.txt und der Einsatz von Sicherheitsmaßnahmen wie Web Application Firewalls (WAF) und Content Delivery Networks (CDN) können bösartige Crawler blockieren.

Die Verwendung der 'Disallow'-Anweisung gefolgt vom User-Agent-Namen des Crawlers, den Sie in Ihrer robots.txt-Datei blockieren möchten, ist eine effektive Methode, um bestimmte Webcrawler zu blockieren.

Darüber hinaus kann die Implementierung einer Web Application Firewall (WAF) eine Website vor schädlichen Crawlern schützen, indem der Datenverkehr gefiltert wird, bevor er die Website erreicht. Ein Content Delivery Network (CDN) kann dies jedoch abmildern, indem es Anfragen an den Server weiterleitet, der dem Standort des Nutzers am nächsten liegt, und so das Risiko von Bot-Angriffen auf die Website reduziert.

Durch den Einsatz dieser Blockierungstechniken können Sie Ihre Website vor schädlichen Crawlern schützen und Ihren Besuchern ein sicheres Surferlebnis gewährleisten.

Siehe auch: Die besten WordPress-Sicherheitsdienstleister

Zusammenfassung

Zusammenfassend lässt sich sagen, dass Webcrawler eine entscheidende Rolle in der digitalen Landschaft spielen, da sie Webseiten indexieren, Daten sammeln und Suchmaschinen so die Möglichkeit geben, qualitativ hochwertige Ergebnisse zu liefern.

Das Verständnis der verschiedenen Arten von Webcrawlern und ihrer Funktionen kann wertvolle Einblicke in die Optimierung Ihrer Website und in den Wettbewerb in der digitalen Welt liefern.

Durch die Implementierung geeigneter Sicherheitsmaßnahmen und Blockierungstechniken können Sie Ihre Website vor schädlichen Crawlern schützen und eine sichere Online-Umgebung für Ihre Benutzer gewährleisten.

Häufig gestellte Fragen

Was sind einige Beispiele für Crawler?

Beispiele für Webcrawler sind Googlebot (Desktop- und Mobilversionen), Bingbot, DuckDuckBot, Yahoo Slurp, YandexBot, Baiduspider und ExaBot.

Was ist eine Crawler-Suchmaschine?

Ein Crawler-Suchmaschinen-Tool, auch Spider, Roboter oder Bot genannt, ist ein automatisiertes Programm, das systematisch Webseiten durchsucht, um sie für Suchmaschinen zu indexieren.

Was ist ein Crawler und welche Arten gibt es?

Webcrawler sind automatisierte Computerprogramme, die das Internet durchsuchen und oft auch als „Roboter“ bezeichnet werden. Verschiedene Crawler sind auf Web-Scraping , Indexierung und Linkverfolgung spezialisiert. Sie nutzen diese Daten, um Webseiten für Suchergebnisse zusammenzustellen.

Welchen Zweck haben Social-Media-Crawler?

Social-Media-Crawler helfen dabei, Inhalte auf verschiedenen Plattformen zu indexieren und anzuzeigen, wodurch die Benutzerfreundlichkeit verbessert und das Engagement gesteigert wird.

Wie kann ich meine Website vor schädlichen Crawlern schützen?

Implementieren Sie Web Application Firewalls (WAF) und Content Delivery Networks (CDN), um Ihre Website vor bösartigen Crawlern zu schützen.

Was versteht man unter Web Crawling im SEO-Kontext?

Web-Crawling ist der Prozess, bei dem Suchmaschinen mithilfe automatisierter Bots (Crawler) Webseiten scannen und indexieren, um deren Platzierung in den Suchergebnissen zu verbessern.

Welcher ist der beste Webcrawler?

Googlebot ist der leistungsstärkste Webcrawler, aber zu den weiteren beliebten gehören Bingbot, Screaming Frog SEO Spider und AhrefsBot.