Dit websted kan se perfekt ud og stadig fejle i søgninger. Det er her, webcrawlere gør forskellen. De fungerer som de første besøgende på dit websted og bestemmer, hvordan søgemaskiner ser dit indhold. Manuel kontrol af sider for fejl tager tid og inviterer til fejl. Crawlere løser dette hurtigt.

Webcrawlere scanner hver side, link og ressource for at afdække SEO-problemer, der skader synligheden. De hjælper søgemaskiner med at forstå din hjemmesides struktur, indeksere indhold korrekt og rangere sider hurtigere. Fra kontrol af crawlbudget til intern linkning og sidehastighed styrer crawlere smarte SEO-beslutninger.

I denne guide vil du opdage de bedste webcrawlere og hvordan de styrker din SEO-strategi.

TL;DR: De bedste webcrawlere, der styrker SEO og synlighed af webstedet

- Webcrawlere scanner dit websted for at hjælpe søgemaskiner med at indeksere sider, forstå strukturen og forbedre SEO-ydeevnen.

- Forskellige crawlertyper tjener forskellige formål, herunder generelle, fokuserede, inkrementelle, søgemaskine-, sociale medier- og SEO-værktøjscrawlere.

- Populære crawlere som Googlebot, Bingbot, AhrefsBot og Screaming Frog hjælper med at identificere tekniske problemer, backlinks og optimeringshuller.

- Korrekt crawlerstyring ved hjælp af robots.txt, firewalls og CDN'er beskytter dit websted mod ondsindede bots og understøtter samtidig en sund indeksering.

Forståelse af webcrawlere

Webcrawlere, også kendt som webcrawlerbots, er automatiserede programmer, der bevæger sig frem og tilbage på nettet og organiserer indhold med henblik på søgemaskineoptimering, dataindsamling og overvågning.

De er afgørende for at indeksere websider med søgemaskiner som Google, Bingog andre, og for at bruge en brugeragent-token til at identificere sig selv, når de tilgår websteder.

Webcrawlere hjælper også med at overvåge og optimere store websteder ved at identificere SEO-problemer såsom duplikeret indhold, ødelagte links og forkerte metatags. De analyserer crawlede sider og sikrer, at siderne er korrekt struktureret og inkluderet i XML-sitemaps til indeksering.

En omfattende liste over forskellige webcrawlere kan hjælpe med at optimere landingssider til søgemaskiner ved at forstå, hvordan de fungerer.

Læs mere: Hvad er en webcrawler

Sådan fungerer webcrawlere

Webcrawlere scanner systematisk websider og indekserer deres indhold, hvorefter det gemmes i en søgemaskines indeks til hentning som svar på brugernes søgeforespørgsler. De følger links fra en side til en anden og overholder robots.txt-protokollen, hvilket hjælper søgemaskinecrawlere med at bestemme, hvilke URL'er de kan få adgang til på dit websted.

Udviklere eller marketingfolk kan i deres robots.txt-fil på deres websted angive, om de godkender eller afviser bestemte crawlere baseret på deres brugeragent-token.

Forståelse af crawlingprocessen kan gøre dit websted mere tilgængeligt og synligt for søgemaskiner som Google og Bing. Denne viden kan i sidste ende forbedre dit websteds placering og synlighed i søgeresultaterne.

Ønsker du at forbedre din hjemmesides SEO?

Lad vores SEO-eksperter forbedre placeringer og generere organisk trafik med dokumenterede tekniske optimeringer og optimeringer af websitestrukturen.

Lær mere: Sådan rettes "Ny årsag til, at dine videoer ikke indekseres"

Typer af webcrawlere

Der er tre primære typer webcrawlere:

- Generelle crawlere, også kendt som webcrawlere eller spiders, gennemser systematisk websider for at indsamle data til søgemaskineindeksering. Søgemaskiner bruger disse oplysninger til at rangere og præsentere søgeresultater.

- Fokuserede crawlere er rettet mod specifikke typer indhold eller websteder. De er designet til at indsamle oplysninger om et bestemt emne eller domæne.

- Trinvise crawlere gennemgår kun websider, der er blevet opdateret siden den sidste gennemgang. Dette giver dem mulighed for effektivt at indsamle nyt eller ændret indhold uden at gennemgå hele webstedet igen.

Fokuserede crawlere indsamler derimod websider, der overholder en specifik egenskab eller et emne, prioriterer strategisk crawl-fronten og vedligeholder en samling af relevante sider.

Trinvise crawlere gennemgår og gennemgår URL'er igen for at holde de crawlede data opdaterede, hvilket gør dem ideelle til scenarier, der kræver opdaterede, konsistente data.

Relateret: Sådan fungerer søgemaskiner: Crawling, indeksering og rangering

Top 14 webcrawlere du bør kende

Denne omfattende liste over crawlere beskriver de mest almindelige webcrawlere og fremhæver deres rolle i søgemaskineindeksering, dataindsamling og analyse. Disse crawlere omfatter:

- Googlebot

- Bingbot

- Yandex-bot

- Google Bard

- Openai ChatGPT

- Facebook-crawler

- Twitterbot

- Pinterestbot

- AhrefsBot

- SemrushBot

- Moz' kampagnecrawler Rogerbot

- Apache Nutch

- Skrigende frø

- HTTrack

Vi vil udforske hver af disse på crawlerlisten med fokus på deres unikke roller og funktionaliteter.

Kend også: De bedste værktøjer til SEO-revision af websteder

Googlebot

Googlebot, også kendt som brugeragenten Googlebot, er Googles primære webcrawler. Den er ansvarlig for at indeksere og gengive sider for søgemaskinen. Den gennemgår Googles websteder ved at følge links, scanne websider og overholde robots.txt-regler, hvilket sikrer, at webstedsindhold er tilgængeligt for Googles søgemaskine.

Det er vigtigt at være fortrolig med Googlebot, da dens crawlingproces kan forbedre din hjemmesides placering i søgemaskinerne og synlighed markant.

Bingbot

Bingbot er Microsofts webcrawler til Bing-søgemaskinen med en mobilorienteret indekseringstilgang. Den fokuserer på at indeksere mobilversionen af websteder og lægger vægt på mobilvenligt indhold i søgeresultaterne for at imødekomme den mobilcentrerede natur af moderne browsing.

Det minder om Googlebot, og den førende kinesiske søgemaskine er en afgørende crawler for dem, der ønsker, at deres indhold skal være synligt på tværs af flere søgemaskiner.

Tjek ud: De bedste digitale marketingstrategier til lokale virksomheder

Yandex-bot

Yandex Bot er webcrawleren for den russiske søgemaskine Yandex, der prioriterer kyrillisk skrift og russisksproget indhold. Den er ansvarlig for at crawle og indeksere overvejende russiske websteder og imødekomme de specifikke behov hos det russisktalende publikum.

Yandex Bot er en afgørende webcrawler for dem, der målretter sig mod det russiske marked, for at optimere deres indhold.

Google Bard

Google Bard er en webcrawler til Googles generative API'er for Bard og Vertex AI, der hjælper webudgivere med at administrere forbedringer af websteder.

Det kan hjælpe webudgivere med at administrere forbedringer af webstedet ved at tilbyde mere præcise svar, integrere med Google-apps og -tjenester og gøre det muligt for udgivere at regulere AI-træningsdata.

Det forbedrer synligheden af kildeindhold og giver ægte citater i svar, hvilket gør det til et værdifuldt værktøj for webudgivere, der ønsker at optimere deres indhold.

Find ud af: Sådan migrerer du fra Blogger til WordPress

OpenAI ChatGPT

OpenAIs webcrawler forbedrer AI'ens muligheder betydeligt, hvilket resulterer i en bedre brugeroplevelse og mere præcise svar fra den AI-drevne chatbot.

Det er en webcrawler, der bruges af OpenAI til træning og forbedring af sine sprogmodeller. GPTBot indsamler offentligt tilgængelige data fra websteder for at forbedre kunstig intelligens-modeller såsom GPT-4.

Fortsæt med at læse: Sådan får du vist Googles cachelagrede sider

Sociale mediecrawlere

Sociale medie-crawlere forbedrer brugeroplevelsen og engagementet på forskellige platforme. De indekserer og viser delt indhold på platforme som Facebook, Twitter og Pinterest, hvilket giver brugerne visuelt tiltalende og informative forhåndsvisninger af webindhold.

Vi vil nu diskutere tre bemærkelsesværdige sociale medie-crawlere: Facebook Crawler, Twitterbot og Pinterestbot.

Facebook-crawler

Facebook Crawler indsamler hjemmesideoplysninger, der deles på platformen, og genererer omfattende forhåndsvisninger, herunder en titel, en kort beskrivelse og et miniaturebillede.

Dette giver brugerne mulighed for at få et hurtigt overblik over det delte indhold, før de klikker på linket, hvilket forbedrer brugeroplevelsen og fremmer engagement.

Facebook Crawler optimerer delt indhold til platformen og giver brugerne en visuelt engagerende og informativ browsingoplevelse.

Twitterbot

Twitterbot, Twitters webcrawler, indekserer og viser delte URL'er for at vise forhåndsvisninger af webindhold på platformen.

Ved at generere forhåndsvisningskort med titler, beskrivelser og billeder giver Twitterbot brugerne et øjebliksbillede af delt indhold, hvilket fremmer brugerengagement og interaktion.

Twitterbot optimerer indhold til Twitter-platformen, hvilket gør det nemmere for brugerne at opdage og interagere med delt indhold.

Pinterestbot

Det er en webcrawler til den visuelt drevne sociale platform, der fokuserer på at indeksere billeder og indhold til visning på platformen. Pinterestbot crawler og indekserer billeder, hvilket gør det muligt for brugerne at opdage og gemme visuel inspiration via pins og boards.

Dens primære funktion er at give brugerne en visuelt imponerende og organiseret browseroplevelse, der gør det muligt for dem at udforske og interagere med indhold, der er skræddersyet til deres interesser.

Lær: Hvorfor er din WordPress langsom?

SEO-værktøjscrawlerliste

SEO-værktøjscrawlere er afgørende for at indsamle data til analyse og optimering af websteders ydeevne på forskellige SEO-platforme.

Disse crawlere giver værdifuld indsigt i webstedsstruktur, backlinksog brugerengagement, hvilket hjælper webstedsejere og marketingfolk med at træffe informerede beslutninger for at forbedre deres online tilstedeværelse.

Vi vil nu udforske tre populære SEO-værktøjscrawlere: AhrefsBot, SemrushBot og Moz's kampagnecrawler, Rogerbot.

AhrefsBot

AhrefsBot er en webcrawler, der indekserer links til Ahrefs SEO-software. Den besøger 6 milliarder websteder dagligt, hvilket gør den til den næstmest aktive crawler efter Googlebot.

AhrefsBot gennemgår hjemmesider for at indsamle oplysninger om backlinks, søgeord og andre SEO-faktorer. Det bruges til at informere optimeringsbeslutninger.

AhrefsBot er et værdifuldt værktøj for dem, der ønsker at forbedre deres hjemmesides placering i søgemaskinerne og synlighed. Det gælder også for hjemmesideejere, SEO-professionelle og marketingfolk.

SemrushBot

SemrushBot er en webcrawlerbot, der anvendes af Semrush, en førende SEO-softwareudbyder. Den indsamler og katalogiserer hjemmesidedata til kundernes brug på sin platform. Den genererer en liste over webside-URL'er, besøger dem og gemmer bestemte hyperlinks til fremtidige besøg.

SemrushBots data anvendes i adskillige Semrush-værktøjer, herunder:

- Offentlig backlink-søgemaskine

- Værktøj til webstedsrevision

- Værktøj til backlink-revision

- Linkbuilding-værktøj

- Skriveassistent

Disse værktøjer giver værdifuld indsigt i optimering af websteders ydeevne og SEO-strategier.

Moz' kampagnecrawler Rogerbot

Moz's Campaign Crawler Rogerbot er en webcrawler, der er specielt designet til Moz Pro Campaign-webstedsrevisioner. Den førende SEO-websted, Moz, leverer den.

Den indsamler indhold til Moz Pro Campaign-revisioner og overholder robots.txt-regler for at sikre overholdelse af webstedsejerens præferencer.

Rogerbot er et værdifuldt værktøj for hjemmesideejere og marketingfolk, der ønsker at forbedre deres hjemmesides placering i søgemaskinerne og synlighed. Det bruger omfattende hjemmesiderevisioner og datadrevne optimeringsstrategier.

Relateret: Optimal SEO på WordPress: En omfattende guide

Open Source-crawlere

Open source-crawlere tilbyder fleksibilitet og skalerbarhed til specifik hjemmesidecrawling eller storstilet internetcrawling. Disse crawlere kan tilpasses til specifikke behov.

Det gør dem til en værdifuld ressource for webudviklere og SEO-professionelle, der ønsker at optimere deres hjemmesides ydeevne.

Vi vil nu dykke ned i tre open source-crawlere: Apache Nutch, Screaming Frog og HTTrack.

Apache Nutch

Apache Nutch er ideel til webudviklere og SEO-professionelle, der har brug for en brugerdefineret webcrawler, der opfylder deres specifikke behov, uanset om det drejer sig om at crawle et bestemt websted eller udføre storstilede internetcrawls.

- En fleksibel og skalerbar open source webcrawler

- Bruges til at gennemgå bestemte websteder eller hele internettet

- Baseret på Apache Hadoop-datastrukturer

- Det kan konfigureres i detaljer.

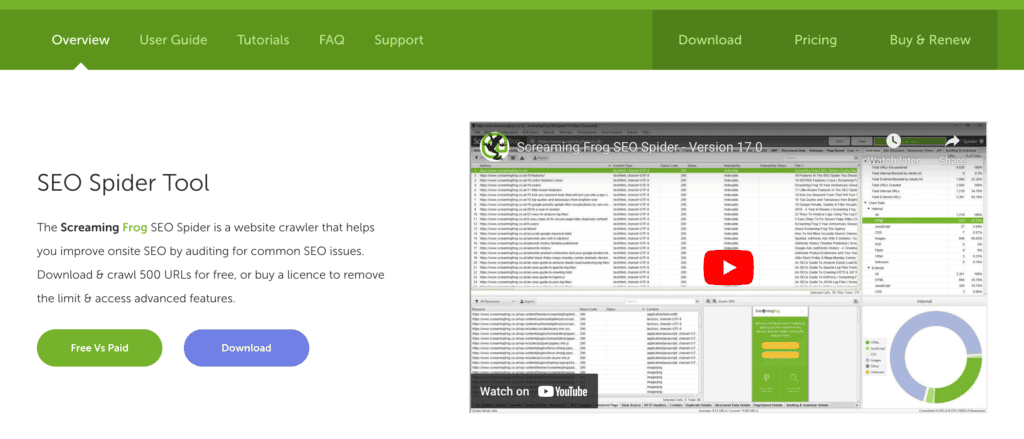

Skrigende frø

Screaming Frog er et desktopværktøj til at crawle hjemmesider fra et SEO-perspektiv, der præsenterer onsite-elementer i faner til analyse og filtrering i realtid. Det er kendt for sin brugervenlige grænseflade og hurtighed i at producere tekniske resultater, der maksimerer Google-crawls.

Screaming Frog er en vigtig ressource for webudviklere og SEO-professionelle, der søger at forbedre deres hjemmesiders ydeevne gennem omfattende hjemmesiderevisioner og datadrevne optimeringsstrategier.

HTTrack

HTTrack er et gratis program, der kan downloade og spejle websteder, understøtter flere systemer og mange funktioner. Det fungerer ved at bruge en webcrawler til at hente webstedets filer og organisere dem i en struktur, der bevarer det oprindelige websteds relative linkstruktur.

Dette gør det muligt for brugerne at browse den downloadede hjemmeside offline ved hjælp af enhver webbrowser. HTTrack er et værdifuldt værktøj for hjemmesideejere og marketingfolk, der ønsker at oprette en lokal kopi af en hjemmeside til offline browsing eller replikering.

Lær mere: Migrer dit websted til WordPress

Beskyttelse af dit websted mod ondsindede crawlere

at beskytte dit websted mod ondsindede crawlere for at forhindre svindel, angreb og informationstyveri.

Identifikation og blokering af disse skadelige crawlere kan beskytte dit websteds indhold, brugerdata og online tilstedeværelse. Det gør dine besøgendes browseroplevelse sikker og tryg.

Vi vil nu diskutere teknikker til at identificere ondsindede crawlere og metoder til at blokere deres adgang til dit websted.

Identificering af ondsindede crawlere

Identifikation af ondsindede crawlere involverer kontrol af brugeragenter, herunder hele brugeragentstrengen, brugeragentstrengen desktop, brugeragentstrengen og IP-adresser i webstedsposter.

Du kan skelne mellem legitime og ondsindede webcrawlere ved at analysere disse karakteristika. Dette hjælper dig med at træffe passende foranstaltninger for at beskytte dit websted mod potentielle trusler.

Regelmæssig overvågning af dit websteds adgangslogfiler og implementering af sikkerhedsforanstaltninger kan hjælpe med at opretholde et sikkert onlinemiljø for dine brugere.

Blokeringsteknikker

Teknikker som justering af tilladelser via robots.txt og implementering af sikkerhedsforanstaltninger, såsom webapplikationsfirewalls (WAF) og indholdsleveringsnetværk (CDN), kan blokere ondsindede crawlere.

Brug af 'Disallow'-direktivet efterfulgt af brugeragentnavnet på den crawler, du vil blokere, i din robots.txt-fil er en effektiv måde at blokere specifikke webcrawlere på.

Derudover kan implementering af en WAF beskytte et websted mod ondsindede crawlere ved at filtrere trafik, før den når webstedet. I modsætning hertil kan et CDN afbøde dette ved at dirigere anmodninger til den server, der er tættest på brugerens placering, hvilket reducerer risikoen for botangreb på webstedet.

Brug af disse blokeringsteknikker kan hjælpe med at beskytte dit websted mod skadelige crawlere og sikre en sikker browseroplevelse for dine besøgende.

Relateret: Bedste WordPress-sikkerhedsudbydere

Oversigt

Afslutningsvis spiller webcrawlere en afgørende rolle i det digitale landskab, da de indekserer websider, indsamler data og gør det muligt for søgemaskiner at levere resultater af høj kvalitet.

Forståelse af de forskellige typer webcrawlere og deres funktioner kan give værdifuld indsigt i at optimere dit websted og holde dig foran i den digitale verden.

Ved at implementere passende sikkerhedsforanstaltninger og blokeringsteknikker kan du beskytte dit websted mod ondsindede crawlere og opretholde et sikkert og trygt onlinemiljø for dine brugere.

Ofte stillede spørgsmål

Hvad er nogle eksempler på crawlere?

Eksempler på webcrawlere inkluderer Googlebot (desktop- og mobilversioner), Bingbot, DuckDuckBot, Yahoo Slurp, YandexBot, Baiduspider og ExaBot.

Hvad er en crawler-søgemaskine?

En crawler-søgemaskine, også kendt som en spider, robot eller bot, er et automatiseret program, der systematisk gennemser websider for at indeksere dem til søgemaskiner.

Hvad er en crawler, og hvad er dens typer?

Crawlere er automatiserede computerprogrammer, der søger på internettet, ofte omtalt som 'robotter'. Forskellige crawlere specialiserer sig i webscraping, indeksering og linkfollowing. De bruger disse data til at samle websider til søgeresultater.

Hvad er formålet med sociale medie-crawlere?

Sociale mediecrawlere hjælper med at indeksere og vise indhold på flere platforme, hvilket forbedrer brugeroplevelsen og øger engagementet.

Hvordan kan jeg beskytte mit websted mod ondsindede crawlere?

Implementer webapplikationsfirewalls (WAF) og indholdsleveringsnetværk (CDN) for at beskytte dit websted mod ondsindede crawlere.

Hvad er webcrawling i SEO?

Webcrawling er den proces, hvormed søgemaskiner scanner og indekserer websider ved hjælp af automatiserede bots (crawlere) for at hjælpe med at rangere dem i søgeresultaterne.

Hvad er den bedste webcrawler?

Googlebot er den mest kraftfulde webcrawler, men andre populære inkluderer Bingbot, Screaming Frog SEO Spider og AhrefsBot.