Webcrawler, die von Suchmaschinen eingesetzt werden und oft als Spider oder Bots bezeichnet werden, haben die Aufgabe, Inhalte aus dem Internet herunterzuladen und zu indizieren. Ein Bot wie dieser soll sich mit dem Inhalt von (fast) jeder Website im Internet vertraut machen, um sicherzustellen, dass relevante Informationen bei Bedarf abgerufen werden können.

In den meisten Fällen sind die Suchmaschinen für den Betrieb dieser Bots und deren Wartung verantwortlich. Wenn ein Nutzer mit Google oder Bing sucht, wird eine Liste von Websites erstellt, die als Ergebnisse zurückgegeben werden (oder eine andere Suchmaschine).

Man kann sich einen Web-Crawler-Bot wie eine Person vorstellen, deren Aufgabe es ist, alle Bücher in einer unorganisierten Bibliothek zu durchsuchen und einen Zettelkatalog zu erstellen. Dieser Zettelkatalog steht dann allen Bibliotheksbesuchern zur Verfügung und kann von ihnen genutzt werden, um schnell und einfach die gewünschten Informationen zu finden.

Wie funktionieren Webcrawler?

Das Internet gewinnt ständig an neuen Fähigkeiten und erweitert seinen Aktionsradius. Web-Crawler-Bots beginnen ihre Arbeit mit einem Seed, d. h. einer Liste von URLs, die ihnen bereits bekannt sind. Dieser Seed ist der Ausgangspunkt für ihre Arbeit. Der Grund dafür ist, dass es physisch unmöglich ist, die gesamte Anzahl der im Internet verfügbaren Websites zu kennen. Sie beginnen mit dem Crawlen der Websites, auf die über die angegebenen URLs zugegriffen werden kann. Sie fahren fort, diese Webseiten zu crawlen, bis sie Links zu anderen URLs entdecken; zu diesem Zeitpunkt fügen sie diese Webseiten der Liste der Domänen hinzu, die sie als nächstes crawlen werden.

Es ist denkbar, dass dieser Prozess fast unendlich lange dauern kann, da so viele Websites für Suchzwecke indiziert werden können. Web-Crawler berücksichtigen auch andere Faktoren, die anzeigen, wie wahrscheinlich es ist, dass die Seite sinnvolle Informationen enthält. Die meisten Webcrawler sind nicht darauf ausgelegt, den gesamten öffentlichen Teil des Internets zu durchsuchen. Stattdessen entscheiden sie, welche Websites sie zuerst durchsuchen, indem sie verschiedene Merkmale wie diese berücksichtigen.

Eine Suchmaschine muss eine Website indizieren, die von vielen anderen Webseiten referenziert wird und eine große Anzahl von Besuchen aufweist. Der Grund dafür ist, dass eine solche Webseite mit größerer Wahrscheinlichkeit Inhalte von hoher Qualität und Autorität enthält. Diese Situation ist vergleichbar mit der, in der eine Bibliothek sicherstellt, dass sie über eine ausreichende Anzahl von Exemplaren eines Buches verfügt, das häufig von vielen Kunden ausgeliehen wird.

Untersuchung von zuvor besuchten Websites

Die Informationen, die im World Wide Web zu finden sind, werden ständig aktualisiert, entfernt oder auf andere Websites verschoben. Web-Crawler müssen die Websites, die sie indizieren, häufig besuchen, um sicherzustellen, dass ihre Datenbanken die aktuellste Version des Materials enthalten.

Innerhalb der spezialisierten Algorithmen, die von den Spider-Bots der verschiedenen Suchmaschinen verwendet werden, haben diese Faktoren eine unterschiedliche Bedeutung erlangt. Das Endziel aller Webcrawler ist jedoch dasselbe: das Herunterladen und Indizieren von Inhalten von Websites. Die Webcrawler der verschiedenen Suchmaschinen verhalten sich jedoch leicht unterschiedlich.

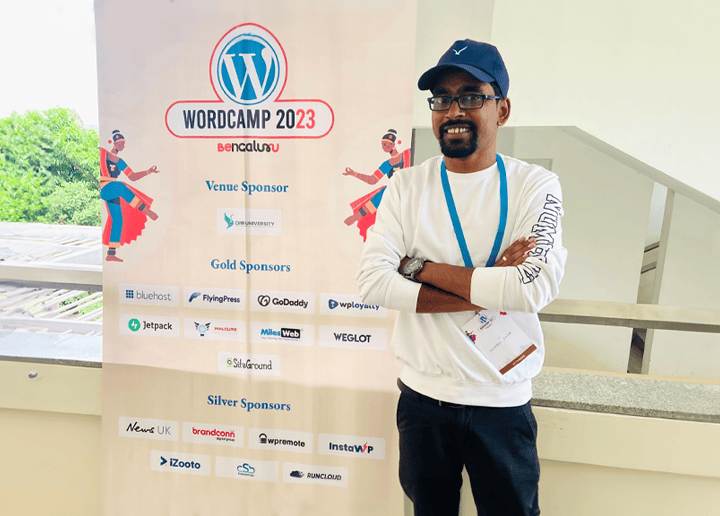

Weitere Artikel dieser Art finden Sie auf Seahawkmedia .